2026 OpenClaw Gateway-Troubleshooting: Die Leiter status → logs → doctor (Port 18789 & Kanäle)

Fortgeschrittene scheitern selten an der Installation, sondern daran, dass der Dienst läuft, Kanäle aber schweigen. Dieser Leitfaden erzwingt die Reihenfolge Kontrollebene (openclaw status), Beweise (openclaw logs), Diagnose (openclaw doctor), dann gezielte Fixes. Themen: Konflikt auf 18789, abgelaufenes Pairing, verbunden ohne Antwort, SSH-Tunnel auf Mac-Cloud statt nacktem Internet-Port.

1. Warum Reihenfolge

Eine Zeile runtime: running beweist nicht, dass 18789 korrekt lauscht, dass Pairing gültig ist oder dass IM-Webhooks wirklich ankommen. Wer vor status Modellparameter dreht oder doctor --fix ausführt, bevor JSONL in fester Reihenfolge gelesen wurde, verwechselt häufig Kanalrechte mit „faulen“ Modellen und Remote-URL-Drift mit Provider-Rate-Limits. Mindeststandard 2026: vor jedem Neustart status plus ein zeitlich begrenztes Logfenster sichern, um Rauschen von Konfigurationsdrift zu trennen.

Schichten helfen, weil dieselbe Timeout-Meldung von Gateway-RTT, blockierten IM-Callbacks oder hängenden Provider-Sockets stammen kann. Markieren Sie Vorfälle intern als Kontrolle / Daten / Kanal, damit Postmortems zeitlich stimmig bleiben.

2. Schichten

- Kontrollebene: Bei

gateway.mode=remotekann ein lokaler Prozess leerlaufen; prüfen Sie Bind, Listener und Probes—nicht nur Runtime. - Datenebene: Ohne feste Log-Reihenfolge ertrinken Sie in INFO-Heartbeats; zuerst WARN/ERROR, dann Expansion nach request id. JSONL bevorzugen.

- Kanalebene: „Verbunden, aber stumm“ passt zu Mention-Regeln, Gruppenrechten, abgelaufenem Pairing oder Bot-Scopes—nicht immer als ERROR im

doctorsichtbar.

Diese Linse verhindert reflexhaftes Temperatur-Tuning, wenn der Webhook Ihren Prozess nie erreicht hat—Teams verbrennen Stunden mit „responsiverem Modell“, während ein Slack-OAuth-Scope fehlt.

3. Routing-Tabelle

| Symptom | Schicht | Nicht zuerst |

|---|---|---|

| curl 18789 scheitert | Kontrolle | Modell tauschen |

| JSON5-Fehler | Config | State löschen |

| DM ok, Gruppe stumm | Kanal | Temperature |

| 429-Streak | Modell | Restart-Schleife |

| Pairing bricht nach Minuten | Kanal + Uhr | nur npm neu |

Bei Eskalationen: scheitert Loopback-curl, rotieren Sie keine Kanal-Tokens, bevor der Listener steht. Funktionieren DMs, Gruppen aber nicht, bleiben Sie in der Kanalebene und vergleichen Mention-Policies.

4. Schritte

Gleiche Reihenfolge auf Linux, macOS oder Mac-Cloud. Unter Docker Befehle im gleichen Namespace ausführen; doctor auf Host und Container nur vergleichen, wenn dieselben Dateien gemountet sind.

- Baseline

openclaw status: Runtime, Gateway-Modus, Bind notieren; bei Remote auch Upstream-URL und Health. openclaw logs: ±10 Minuten um Releases; WARN/ERROR zuerst, dann request id; TLS/DNS vor Token-Fixes.openclaw doctor: Ohne--fixlesen; Backup von~/.openclawoder Volumes vor Auto-Fix.- Port 18789: Besitzerprozess finden; Loopback plus SSH-Tunnel oder Reverse-Proxy statt nacktem Internet-Port.

- Kanäle: status/probe je Version; Pairing erneuern; Bot-Scopes und Mentions prüfen.

- Regression: Minimaler DM-Test, dann Tools, dann Volllast.

Archivieren Sie „bekannt gut“-status und redigierte Logs im Runbook—künftige Bereitschaft kann dagegen diffen statt zu raten.

5. Fakten

- 18789: üblicher Default-Port—Release Notes prüfen; Konflikte oft doppelte Instanzen.

- Pairing-TTL: Codes laufen ab—IM-seitig sofort bestätigen.

- Korrelation: request id, channel id, Provider-Codes für Abgleich mit Token-Abrechnung.

- Upgrade/Rollback: Migrationshinweise lesen; Logauszüge für Postmortems behalten.

- Audit: JSONL-Pfade und Rotation dokumentieren.

- Docker: Abweichende doctor-Ergebnisse → Volumes/uid vor Kanal-Geheimnissen ändern.

- Zeitdrift: VMs/Container mit falscher Uhr brechen TLS/OAuth—Zeit sync auf Host und im Container prüfen.

- Retry-Stürme: Unbegrenzte Retries überdecken die erste nutzbare Zeile; nach Recovery kontrollierter Neustart im Wartungsfenster.

- Org-weite Last: Viele Agenten hinter einer Egress-IP können gemeinsame Limits triggern—429s mit anderen Diensten korrelieren.

6. Mac-Cloud

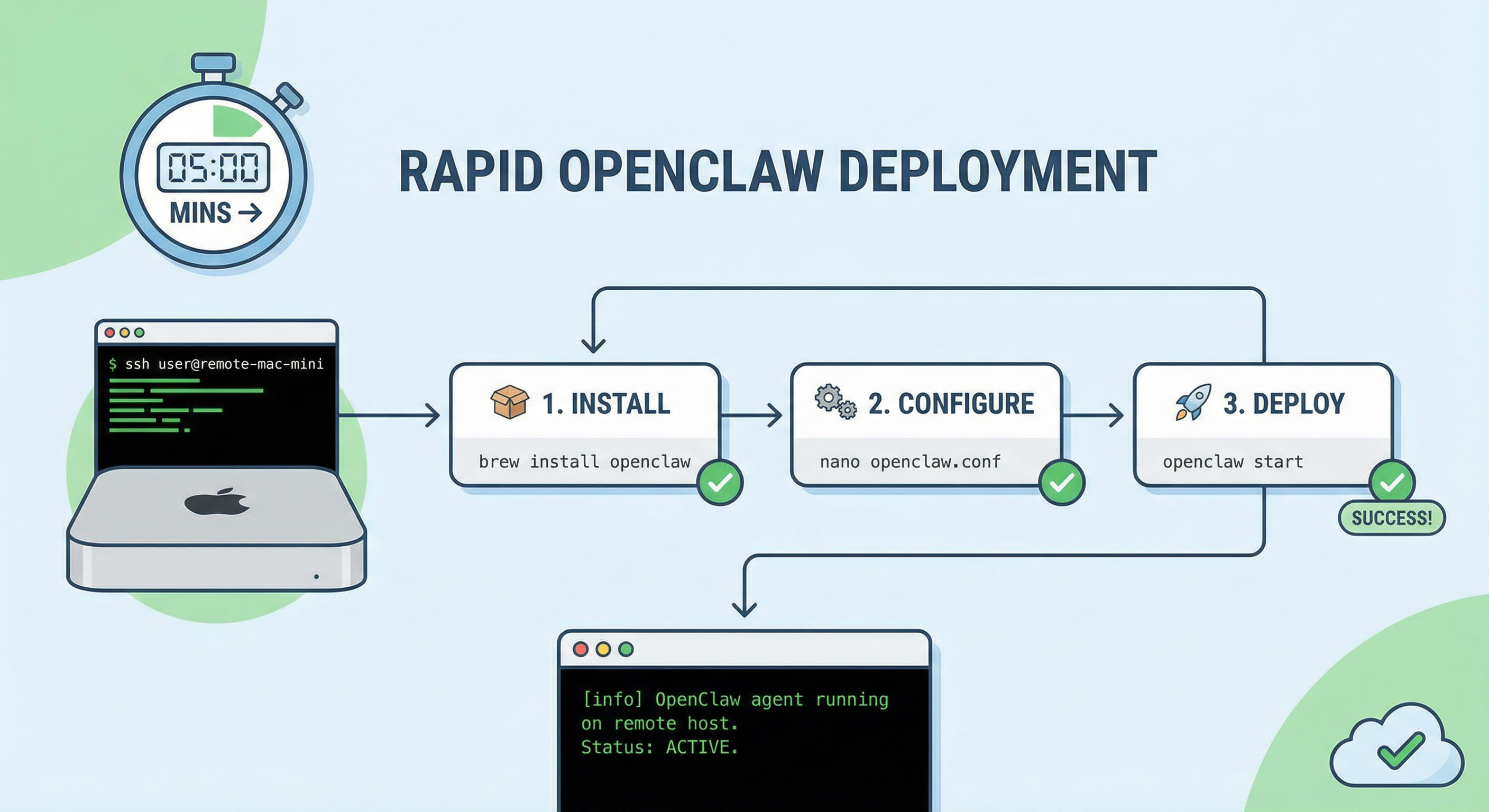

24/7 auf Mac-Cloud ändert Betreuung, Log-Persistenz und Exposition. Nur Browser ohne Tunnel bricht nach Reboots; 18789 öffentlich zieht Scanner an. SSH-Tunnel oder Zero-Trust verkleinern die Fläche, brauchen aber Schlüsselrotation. Günstige Nicht-Mac-Hosts erschweren langfristige Daemons und Toolchain-Parität. Für native macOS-, launchd-taugliche Betrieb mit derselben Triage-Leiter lohnt ein dedizierter VPSMAC-Mac-Cloud-Knoten. Erste Einrichtung: OpenClaw-5-Minuten-Artikel auf der Site.

Docker auf Linux kann OpenClaw hosten, kostet aber uid-Mapping und doppelte Config-Wahrheit. Ein Mac-Cloud-Knoten reduziert Übersetzungsschichten zwischen Doku und Produktion.

Behandeln Sie Provider-Dashboards und IM-Konsolen als Beweiskette: Screenshots zu Rate-Limits mit request ids aus JSONL, damit Finance, Security und Engineering eine Timeline teilen.

Behalten Sie diese Checkliste neben jedem Upgrade: Leiter auch in Staging vor Produktion—subtile Bind- und Auth-Defaults brechen auch „langweilige“ Releases.

Ein typischer Montagmorgen-Fehler ist die Vermischung von Gateway-erreichbar und Dienst gesund: Healthchecks können grün sein, während der RPC-Pfad für eine Teilfunktion—zum Beispiel Tool-Aufrufe—noch auf eine alte Bind-Adresse zeigt. Dokumentieren Sie deshalb nicht nur HTTP-200, sondern auch einen kurzen synthetischen Aufruf, der dem produktiven Pfad entspricht. Wenn Ihr Team Kanäle in mehreren Workspaces betreibt, legen Sie pro Workspace eine Mini-Checkliste an: Bot eingeladen, Slash-Command registriert, Event-URL erreichbar vom gleichen Egress wie das Gateway.

Für Netzwerkteams: wenn Corporate-Firewalls ausgehende Verbindungen zu IM-APIs drosseln, sehen Sie möglicherweise sporadische TLS-Handshake-Fehler statt klassischer TIMEOUT-Meldungen. Sammeln Sie fünf Beispielzeilen mit Zeitstempel und ASN, bevor Sie Firewall-Regeln ändern—sonst wird aus einem gezielten Allowlist-Eintrag ein breites „alles offen“.

Zu Observability: selbst ohne Prometheus können Sie eine einfache Tabelle pführen—Datum, Gateway-Version, durchschnittliche Antwortzeit der ersten Tokens, Anzahl der WARN-Zeilen pro Stunde. Trends über zwei Wochen zeigen Verschlechterungen früher als die monatliche Rechnung. Kombinieren Sie das mit gelegentlichen channels status --probe-Läufen (sofern Ihre CLI-Version das unterstützt), um regressionsanfällige Plugin-Updates früh zu erkennen.

Abschließend: schulen Sie neue Teammitglieder zuerst im Lesen von Logs, nicht im Editieren von Prompts. Die meisten produktiven Ausfälle sind Konfigurations- oder Kanalprobleme; wenn jeder die Leiter auswendig kennt, sinkt die mittlere Zeit bis zur ersten sinnvollen Maßnahme dramatisch. Das ist der eigentliche ROI dieser Seite—nicht neue Features, sondern weniger blindes Neustarten.

Planen Sie zudem einen halbjährlichen „Chaos light“-Tag: absichtlich einen Kanal trennen, beobachten, ob Alarme und Logs Ihre Runbook-Schritte triggern, und danach dokumentieren, welche Metrik zuerst rot wurde. Ohne solche Übungen überschätzen Teams oft ihre mittlere Erkennungszeit—und unterschätzen, wie schnell kleine Drifts bei wachsender Nutzerzahl eskalieren.

Wenn Sie mehrere Umgebungen (Dev/Staging/Prod) führen, halten Sie die Gateway-Minor-Versionen möglichst nah beieinander. Nicht jede Abweichung ist vermeidbar, aber große Sprünge zwischen Staging und Produktion verwandeln jeden Release in Ratespiel: der Doctor meldet in Staging grün, weil eine Umgebungsvariable dort gesetzt ist, die in Prod fehlt—genau die Sorte Bug, die nachts um drei Uhr passiert.

Langfristig lohnt sich ein gemeinsames Glossar: wie heißt bei Ihnen der Vorgang, wenn ein Pairing abläuft, wer darf Tokens rotieren, und wo liegt die „Single Source of Truth“ für Kanal-IDs? Je weniger diese Begriffe im Slack-Thread neu verhandelt werden müssen, desto schneller bewegt sich die Leiter von der ersten Warnung zur dauerhaften Korrektur. Das klingt organisatorisch, ist aber direkt technisch: jede Minute weniger Koordinationsoverhead ist eine Minute mehr für echte Ursachenanalyse.

Kurz gesagt: behandeln Sie diese Seite als Betriebshandbuch, nicht als Marketingtext. Wenn Sie sie mit Ihrem tatsächlichen CLI-Output und Ihren internen Freigaben abgleichen, wird sie zur schnellsten Route zurück zu stabilen Nachrichten—egal ob Sie auf einem Mac mini in der Ecke oder auf einem gemieteten M4-Knoten laufen.

Wer zusätzlich automatisierte End-to-End-Tests baut, sollte mindestens einen Fall pflegen, der bewusst ein abgelaufenes Pairing simuliert—nur so stellen Sie sicher, dass Ihre Alarme nicht nur „grün“ sind, sondern auch bei realistischen IM-Fehlern auslösen.

Und notieren Sie schließlich, welche CLI-Flags Ihre Distribution wirklich unterstützt—Hilfetexte ändern sich zwischen Minor-Releases schneller als Blogbeiträge.

Damit haben Sie genug Material, um wöchentliche kurze, schnelle und effiziente 15-Minuten-Reviews ohne Überraschungen zu bestehen.