2026 OpenClaw mit Ollama in der Mac Cloud: Provider-Konfiguration, Health Checks und Cloud-Fallback

Wer leidet und was bricht: Teams, die OpenClaw bereits mit Cloud-API-Keys betreiben, wollen Ollama auf demselben Mac-Host für geringere Latenz und planbare Kosten—doch in Produktion folgen endlose Thinking-Zustände, rätselhafte HTTP-500-Antworten und Diskussionen, ob Slack oder das Gateway schuld ist.Was Sie hier bekommen: Eine Matrix zu co-located versus getrennter Topologie, konkrete Schritte für Basis-URL und Modellstrings, Leitplanken zu Timeouts und Retries, einen sekundären Cloud-Provider als budgetierten Fallback sowie eine Doctor-first-Triage-Reihenfolge.Aufbau: Nummerierte Schmerzpunkte, zwei Tabellen, sieben Umsetzungsschritte, harte Kennzahlen für Reviews, eine Brücke dazu, warum Bare-Metal-Mac-Cloud gegenüber geflickten Windows-Stacks oder verschachteltem macOS überzeugt, plus FAQ und HowTo-JSON-LD. Exakte Konfigurationsschlüssel entnehmen Sie bitte Ihren OpenClaw-Release-Notes.

Inhalt

- 1. Kurzüberblick: Gateway, Ollama und Cloud-Keys

- 2. Schmerzpunkte: Ports, Namen, Timeouts, Kanäle

- 3. Topologie-Matrix: co-located versus getrenntes Ollama

- 4. Sieben Schritte von leerer Konfiguration bis fallback-bereit

- 5. Harte Kennzahlen: Speicher, Parallelität, Timeouts

- 6. Troubleshooting: Doctor, Logs, Kanal-FAQ

1. Kurzüberblick: Gateway, Ollama und Cloud-Keys

Das OpenClaw-Gateway verantwortet Routing, Werkzeuge und Instant-Messaging-Kanäle, während Sprachmodelle entweder über gehostete APIs oder über eine lokale HTTP-Oberfläche bedient werden können. Ollama lauscht typischerweise auf 127.0.0.1:11434 und stellt chat-kompatible Endpunkte bereit. Die teuren Fehler sind selten philosophische Debatten über offene Gewichte; viel häufiger sind mechanische Diskrepanzen zwischen dem Modellstring, den jemand in einer Oberfläche tippt, und dem Tag, den ollama list zurückgibt, oder ein containerisiertes Gateway, das localhost auf sich selbst statt auf den Host auflöst, der tatsächlich ollama serve ausführt. Timeouts, die kürzer sind als der Cold-Start eines Modells, erzeugen systematisch falsch-negative Health-Signale, die sich wie flatternde Intelligenz lesen. Behandeln Sie Provider-Konfiguration als Infrastructure-as-Code: Basis-URL, Modellkennungen und Timeout-Stufen gehören in dasselbe Repository wie Ihre Gateway-Manifeste, damit Rollbacks nicht von mündlicher Folklore in einem Slack-Thread abhängen. Dieser Leitfaden setzt SSH-Zugang auf einer Apple-Silicon-Mac-Cloud-Instanz mit funktionierendem Gateway-Baseline-Install voraus und zielt darauf ab, local-first plus Cloud-Fallback als dokumentiertes Runbook zu etablieren statt als Einmal-Tweak.

Wer nur die Oberfläche sieht, unterschätzt, wie stark Netzwerksemantik zwischen Compose, Bridge und Host variiert. Ein falscher Hostname lässt Anfragen in Retry-Schleifen verschwinden, während Kanäle Heartbeats senden. Dokumentieren Sie URL, bindende Prozesse und ob ein Reverse-Proxy dazwischen sitzt.

Cloud-Keys bleiben Druckventil bei Wartung oder langen Modellwechseln. Begrenzen Sie Fallback so, dass Verfügbarkeit steigt, ohne dass Finanzcontrolling exponentielle Token-Kurven sieht.

2. Schmerzpunkte: Ports, Namen, Timeouts, Kanäle

Support-Threads ballen sich um vier wiederkehrende Themen:

- Bind-Adresse passt nicht: Ollama nur auf Loopback, während das Gateway in Bridge-Netzwerk läuft, oder versehentliche öffentliche Freigabe von Inferenz-Ports ohne Authentifizierung.

- Drift der Modellstrings: Fehlendes

:latest, falscher Registry-Präfix oder Groß- und Kleinschreibung erzeugen 404-Antworten, die in Kanälen wie Stille wirken. - Timeout versus Warteschlange: Mehrere parallele Sessions auf einem 7×24-Knoten strecken die Queue-Tiefe; zu aggressive HTTP-Deadlines brechen ab, bevor Gewichte fertig geladen sind.

- Lücken in der Fallback-Policy: Ohne sekundären Provider erleben Nutzer harte Ausfälle; unbegrenzter Fallback auf Cloud-Keys während eines Vorfalls kann Kostenvorteile invertieren.

Operative Hygiene wiegt ebenso schwer wie YAML. Rotieren Sie API-Keys für Cloud-Fallbacks im gleichen Rhythmus wie Datenbank-Credentials und versehen Sie Vorfälle mit dem Provider, der tatsächlich Traffic bedient hat, damit Finance Peaks zuordnen kann. Wenn mehrere Engineerings denselben Mac-Knoten per SSH betreuen, pinnen Sie Ollama-Upgrades hinter ein Änderungsfenster, weil ein stiller Binary-Bump Standard-Bind-Verhalten oder Tokenizer-Nuancen verschieben kann, die erst in langen Mehr-Runden-Gesprächen auffallen.

Halten Sie pro Kanal Rate-Limits und Mention-Regeln fest, bevor Sie Temperaturen anfassen—sonst tunen Sie Prompts, während OAuth-Scopes oder Webhook-Secrets noch von der Testumgebung abweichen.

Kompass: sprunghafte Symptome zuerst Netzwerk und Identität; Last-korreliert zuerst Queue, Speicher und Platte.

3. Topologie-Matrix: co-located versus getrenntes Ollama

| Dimension | Ollama co-located mit Gateway | Ollama auf separatem Host |

|---|---|---|

| Latenz | Loopback oder Host-Bridge, niedrigste RTT | Erfordert stabile private IP oder Service-DNS |

| Isolation | Prozess-Ebene; gut für Single-Tenant-Mac-Cloud | Blast-Radius getrennt; Ops-Aufwand steigt |

| Exposure | 11434 niemals roh ins öffentliche Internet | Security-Groups auf Gateway-Quellen beschränken |

| Debugging | Lokales curl reicht | Mehrsegment-Traces, ggf. mTLS |

| Passung | PoC bis mittlere Parallelität | Plattform-Teams mit GPU-schweren Modellen |

Wenn Sie Ollama auf einen zweiten Mac oder eine GPU-lastige Maschine auslagern, bevorzugen Sie private RFC1918-Adressierung mit expliziten Firewall-Regeln gegenüber Ad-hoc-SSH-Tunneln, die verschwinden, sobald jemand den Bastion neu startet. Notieren Sie, welches Subnetz das Gateway für ausgehende Calls nutzt und ob mTLS vorgeschrieben ist; falsch ausgerichtete TLS-Truststores maskieren sich als Modellqualitäts-Regressionen, weil das Gateway still mit einem degradierten Pfad erneut versucht.

Für gemietete Mac-Cloud-Knoten ist co-located oft der schnellste Weg zu belastbaren Kennzahlen: Sie messen eine einzige Maschine, eine Uhr und ein gemeinsames Logverzeichnis. Sobald Sie splitten, brauchen Sie zusätzlich Uhr-Sync, einheitliche Zeitstempel in Logs und klare Ownership, wer bei Timeouts welche Seite zuerst prüft.

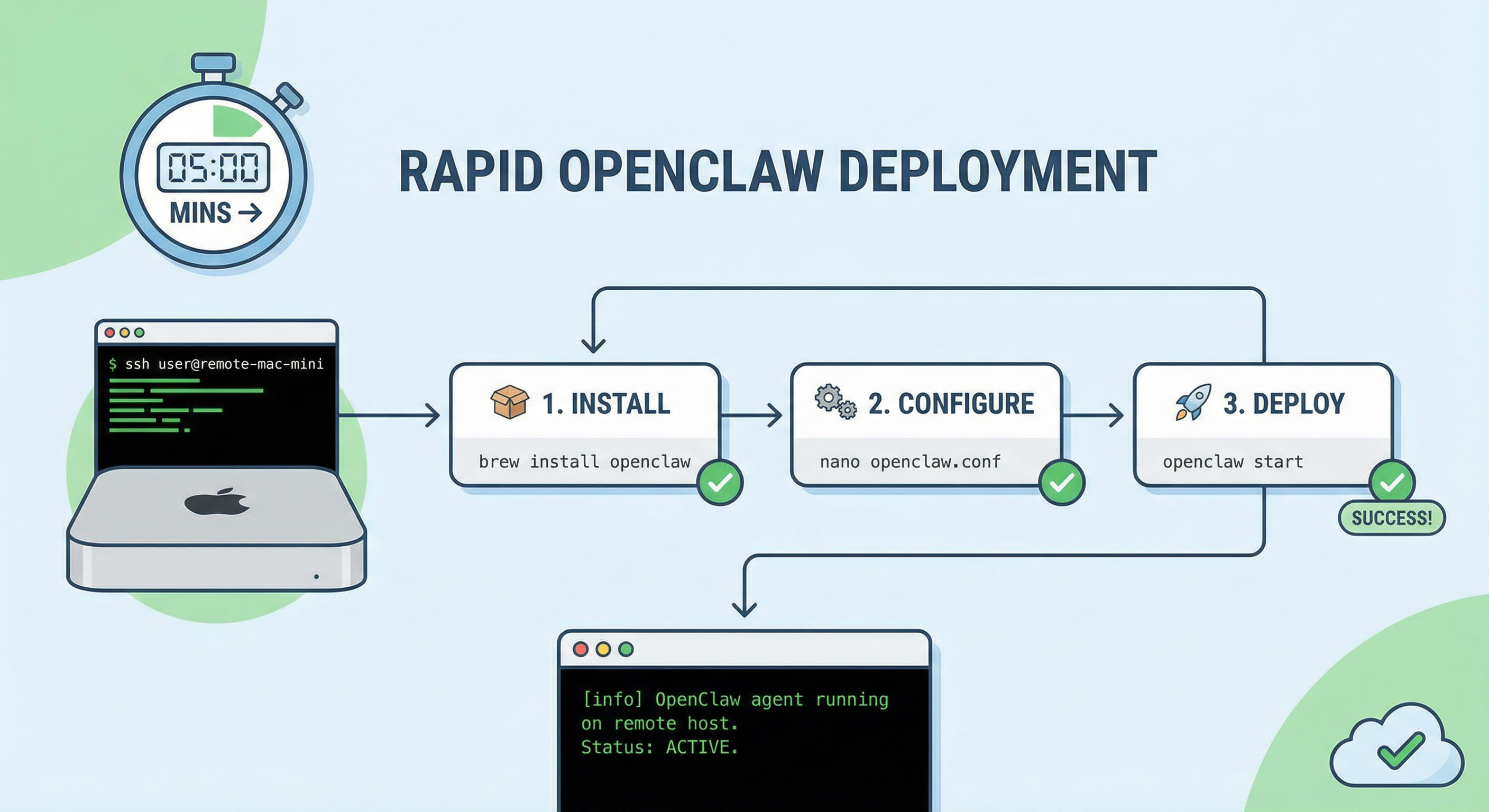

4. Sieben Schritte von leerer Konfiguration bis fallback-bereit

- Installieren und Modelle ziehen: Mit

ollama --versionverifizieren, Gewichte pullen, exakte Namen ausollama listübernehmen. - Health Check:

http://127.0.0.1:11434/api/tagsper curl prüfen oder die Health-Route, die Ihre Version dokumentiert. - Lokalen Provider im Gateway registrieren: Basis-URL passend zum Container-Netzwerk setzen, Modellstring hinterlegen und festhalten, ob OpenAI-kompatible Shims genutzt werden.

- Timeouts schichten: Connect-, First-Byte- und End-to-End-Obergrenzen trennen, um Cold-Start abzufangen ohne Kanal-Heartbeats zu verhungern.

- Cloud-Fallback ergänzen: Sekundären gehosteten Provider mit Token- oder Spend-Caps pro Vorfall konfigurieren.

- Prozesse überwachen: Mit

launchdoder gleichwertiger Startreihenfolge sicherstellen, dass Ollama vor dem Gateway Traffic annimmt; Log-Rotation verdrahten. - Validieren: Drei identische Prompts fahren, Time-to-First-Token und Fehlerrate erfassen, danach parallele Sessions ergänzen, um Queueing zu beobachten.

Schnelle Smoke-Kommandos:

Nach dem Verdrahten der Provider sollten Sie ein synthetisches Lastskript fahren, das Ihren belastetsten Kanal spiegelt: kurze Faktenfragen, lange Zusammenfassungsjobs und tool-augmentierte Runden, sofern Ihr Stack das erlaubt. Erfassen Sie p50 und p95 des Time-to-First-Token getrennt, weil Marketing-Demos Mediane optimieren, während Bereitschaftsschmerz an den Schwänzen hängt. Müssen Sie eine Inferenz-Oberfläche über Loopback hinaus exponieren, terminieren Sie TLS an einem Reverse-Proxy mit Mutual Authentication oder IP-Allow-Lists; rohes öffentliches 11434 lädt Krypto-Miner und versehentliche Datenabflüsse ein.

Änderungen an Provider-Listen gehören in Pull-Requests mit kurzen Latenz-Screens—das spart Tage bei späteren Warum-anders-Fragen.

5. Harte Kennzahlen: Speicher, Parallelität, Timeouts

Nutzen Sie diese Größenordnungen in Planungsdecks; gleichen Sie sie immer mit der exakten Quantisierung ab, die Sie ausrollen:

- Unified Memory: Ein 7B-Q4-Modell benötigt oft rund fünf bis sechs Gigabyte residente Gewichte; Gateway-Plugins plus ein zweites Modell auf zweiunddreißig Gigabyte oder weniger laden unter Burst-Chat-Last zum Swap-Thrash ein.

- Parallelitätsmodell: Behandeln Sie lokale Inferenz als endliche Warteschlange. Ein gängiges Muster ist ein aktives lokales Modell mit Overflow in die Cloud statt unbegrenzter paralleler lokaler Jobs.

- Timeout-Budgetierung: Erlauben Sie beim Cold-Start zig Sekunden bis zum ersten Token; bleibt die p95 im Normalbetrieb über Produktanforderungen, verkleinern Sie Modellgröße oder Parallelität, bevor Sie Timeouts nur senken, um Latenz zu verstecken.

- Plattenhygiene: Mehrere Modellversionen fressen zig Gigabyte; kombinieren Sie

ollama rmmit Plattenalarmen auf gemieteten Mac-Knoten. - Observability: Protokollieren Sie Modellname, Dauer und ob Fallback pro Request ausgelöst wurde, damit Finance Einsparungen gegen Verfügbarkeit vergleichen kann.

- Zuverlässigkeitsbudget: Bei Swap-Spitzen dehnen sich Phasen auch dann, wenn die CPU müßig wirkt; korrelieren Sie mit

vm_stat, bevor Sie den LLM-Stack verdächtigen.

Kapazitätsplanung sollte saisonale Traffic-Spitzen einschließen: Marketing-Pushes und Incident-Brücken multiplizieren parallele Sessions schneller als Tagesmittelkurven vermuten lassen. Halten Sie ein kalt konfiguriertes kleineres Modell im Gateway bereit, damit Sie während Gewichts-Downloads oder Plattenräumaktionen umschalten können, ohne die Cloud-Schleuse weit aufzudrehen. Dokumentieren Sie erwartete Watt-Zahlen und thermisches Verhalten, wenn Sie nahe andere Services colocieren; Apple-Silicon-Effizienz hilft, bis dauerhafte All-Core-Last auf unzureichende Gehäuseluft in dichten Racks trifft.

Review-Folie mit drei Zahlen genügt oft: Median-Latenz lokal, p95 lokal, Anteil Requests mit Fallback—eine Geschichte für Engineering und Finance ohne zehn Dashboards.

Backups und Modell-Caches teilen sich dieselbe NVMe: gleichzeitige Snapshots und Inferenz wirken wie längere Timeouts, obwohl das Modell gesund ist.

6. Troubleshooting: Doctor, Logs, Kanal-FAQ

Folgen Sie einer festen Leiter: openclaw doctor, Gateway-Logs zum Nachrichtenzeitstempel, Ollama-Prozess-Gesundheit, danach Kanal-Kopplungsregeln. Sehen Nutzer Thinking ohne Antwort, klären Sie, ob HTTP abgeschlossen hat; wenn HTTP erfolgreich war, der Chat aber leer bleibt, prüfen Sie Rate-Limits und Mention-Policies. Nutzen Sie die Symptom-Matrix unten in Postmortems.

| Symptom | Zuerst prüfen | Dann prüfen |

|---|---|---|

| Sofortiges 404 | Modellstring gegen ollama list | Falsche Basis-URL oder Container-localhost |

| Intermittierendes Timeout | Cold-Start und Queue-Tiefe | Swap und Plattenlast |

| Kanal-Stille | Gateway hat Tool-Fehler verschluckt | Webhook oder Bot-Scopes |

| Rechnungsspitze nach Fallback | Retry-Stürme in die Cloud | Fehlende Caps im Fallback-Fenster |

macOS-Workloads auf generischen Windows-Desktops oder unlizenzierter verschachtelter Virtualisierung tauschen kurzfristige Hardware-Einsparungen gegen chronische Kompatibilitäts- und Grafikstack-Schulden ein. Reine Docker-Stacks fügen Volume-UID-Rätsel und zusätzliche DNS-Hops hinzu, die erst unter 7×24-Last sichtbar werden. Wenn Sie Apple-Silicon-Vektorleistung, native launchd-Aufsicht und eine einzige SSH-Oberfläche für OpenClaw und Ollama brauchen, schlägt die Miete dedizierter Mac-Cloud-Kapazität meist fragile heterogene Schichten. Kombinieren Sie diese Rechenleistung mit den VPSMAC-Quick-Start-Artikeln, damit Provisioning sich eher wie eine VPS-API anfühlt als wie ein Schulprojekt.

Üben Sie Ausfallmodi vierteljährlich: Beenden Sie Ollama absichtlich, sättigen Sie die Platte und widerrufen Sie einen Cloud-Key, um zu bestätigen, dass Alarme und Fallback-Caps wie designed reagieren. Tabletop-Übungen schlagen es, blinde Flecken erst im kundensichtbaren Ausfall zu entdecken. Wenn Dokumentation, Metriken und Drills zusammenpassen, wird lokale Inferenz keine Science-Fair-Demo, sondern ein langweiliger, abrechenbarer Dienst.