OpenClaw vs. Traditionelle Skripte: Technischer Vergleich KI-gestützter und skriptbasierter macOS-Automatisierung

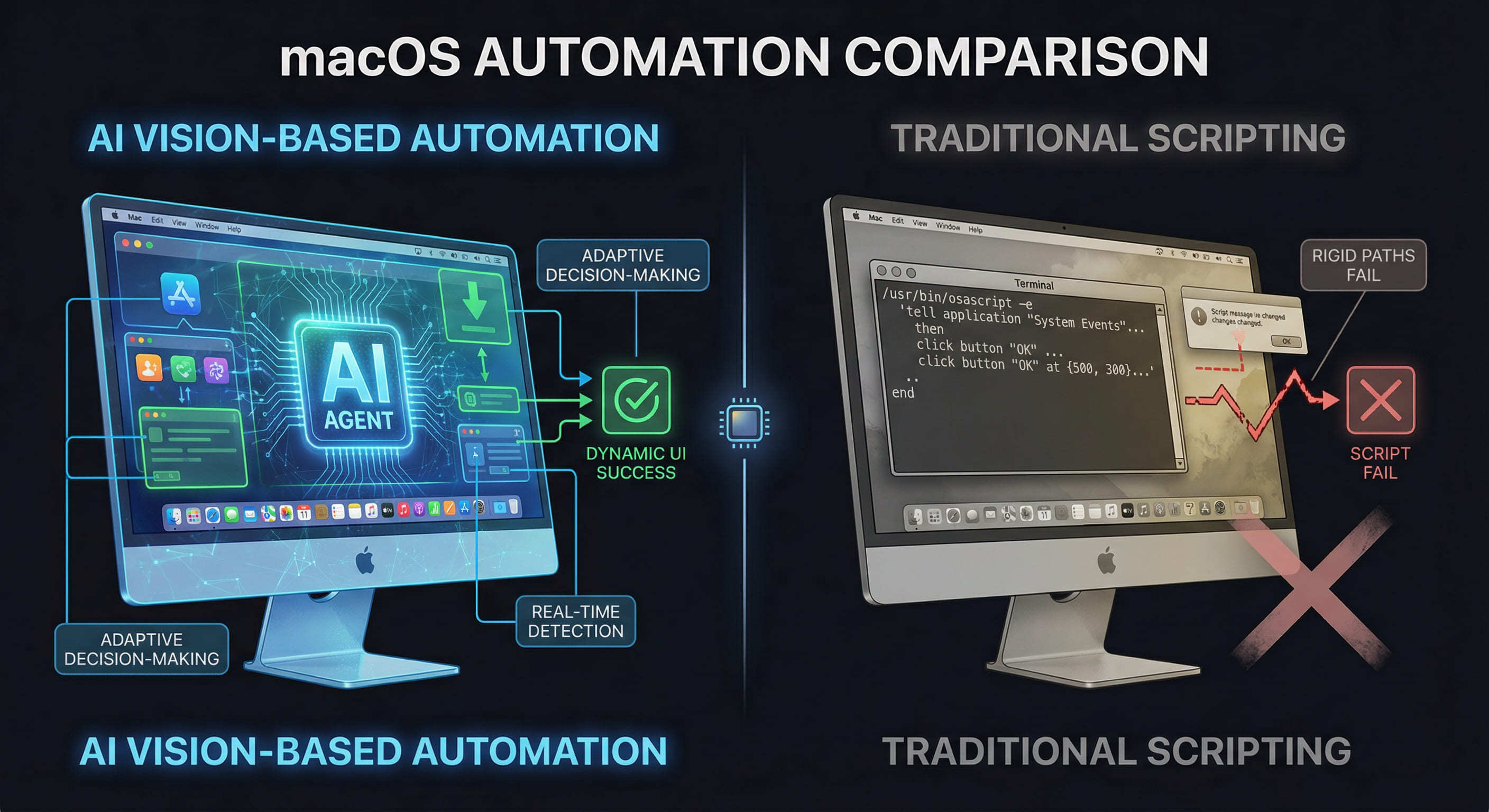

Traditionelle AppleScript- und Shell-basierte Automatisierung dient macOS-Workflows seit Jahrzehnten. KI-gesteuerte Vision-Agenten wie OpenClaw verändern jedoch grundlegend den Ansatz für Remote-UI-Steuerung. Diese technische Analyse vergleicht beide Ansätze hinsichtlich Zuverlässigkeit, Anpassungsfähigkeit und Performance in komplexen Automatisierungsszenarien auf VPSMAC Bare-Metal M4-Knoten.

Problemstellung: macOS-Automatisierung in Remote-Umgebungen

Die Automatisierung von macOS-Workflows – insbesondere für Xcode-Builds, App-Store-Einreichungen und Systemkonfigurationen – basiert traditionell auf Scripting-Tools wie AppleScript, Automator und Shell-Utilities. Diese skriptbasierten Ansätze funktionieren gut für lineare, vorhersehbare Aufgaben, bei denen UI-Elemente über stabile Identifikatoren verfügen und der Systemzustand bekannt ist. In Remote-Rechenszenarien, in denen macOS-Instanzen auf gemieteter M4-Hardware über SSH oder VNC zugänglich sind, stoßen Entwickler jedoch auf Herausforderungen, die die Fragilität traditioneller Skripte offenlegen: asynchrone UI-Updates, timing-abhängige Zustandsübergänge und unvorhersehbare Systemdialoge. Wenn ein Skript davon ausgeht, dass ein Button unter einem bestimmten Accessibility-Pfad existiert, das System aber zuerst einen „Software-Update"-Dialog anzeigt, schlägt die Automatisierung fehl. KI-gesteuerte Agenten wie OpenClaw lösen dies durch Computer Vision und adaptive Entscheidungsfindung anstelle fester Code-Pfade und Accessibility-APIs.

Traditionelle Skript-basierte Automatisierung: Stärken und Grenzen

Skript-basierte Automatisierung auf macOS nutzt typischerweise eine oder mehrere der folgenden Technologien: AppleScript für GUI-Scripting über Accessibility-APIs, Automator-Workflows für vordefinierte Sequenzen, Shell-Skripte mit osascript oder cliclick zur Simulation von Klicks und Tastendrücken sowie Drittanbieter-Tools wie Hammerspoon oder BetterTouchTool für benutzerdefinierte Event-Trigger. Diese Tools eignen sich hervorragend, wenn die UI stabil und der Workflow deterministisch ist. Beispielsweise lässt sich das Öffnen von Xcode, die Auswahl eines Schemas und das Auslösen eines Builds über einen bekannten Tastaturbefehl zuverlässig scripten, sofern Projektstruktur und Xcode-Version konstant bleiben.

Häufige Fehlermodi und technische Einschränkungen

Traditionelle Skripte versagen bei dynamischen UI-Zuständen. Folgende Szenarien treten häufig auf Remote-VPSMAC-Knoten auf:

- Timing-Abhängigkeiten: Ein Skript versucht, „Build" zu klicken, bevor Xcode die Indexierung abgeschlossen hat, wodurch die Aktion fehlschlägt, weil der Button deaktiviert oder noch nicht gerendert ist.

- System-Interrupts: macOS zeigt einen unerwarteten Dialog (Software-Update, Datenschutz-Einwilligung, Credential-Prompt) an, der den vom Skript erwarteten UI-Pfad blockiert und dazu führt, dass die Automatisierung hängt oder mit Fehler beendet wird.

- UI-Layout-Änderungen: Ein OS-Update oder App-Versions-Wechsel verschiebt Elementpositionen oder ändert Accessibility-Identifikatoren, wodurch fest codierte koordinatenbasierte Klicks oder UI-Element-Abfragen fehlschlagen.

- Zustandsabhängige Logik: Das Skript muss basierend auf Build-Erfolg oder -Fehler verzweigen, aber das Erkennen des Ergebnisses erfordert das Parsen visueller Rückmeldungen (z. B. ein grünes Häkchen-Icon oder rotes Fehler-Badge), die Accessibility-APIs nicht zuverlässig bereitstellen.

AppleScript-Beispiel: Starre Pfadabhängigkeit

Ein typisches AppleScript zum Auslösen eines Xcode-Builds könnte folgendermaßen aussehen:

Dieses Skript geht davon aus, dass Xcode nach zwei Sekunden Verzögerung bereit ist, Input zu akzeptieren, dass der Build in genau fünf Minuten abgeschlossen ist und dass das Build-Ergebnis unter einem spezifischen UI-Pfad zugänglich ist. Wenn eine dieser Annahmen bricht, schlägt das Skript stillschweigend fehl oder gibt inkorrekte Daten zurück. In Remote-Szenarien, in denen Netzwerklatenz oder Systemlast variiert, sind feste Delays unzuverlässig, und Accessibility-Pfade sind fragil über macOS-Versionen hinweg.

OpenClaw KI-Agent: Vision-basierte adaptive Automatisierung

OpenClaw operiert nach einem grundlegend anderen Modell. Statt exakte UI-Pfade zu scripten oder sich auf Accessibility-APIs zu verlassen, nutzt es Computer Vision zur Wahrnehmung des Bildschirmzustands und eine Task-Orchestrierungs-Engine für dynamische Aktionsentscheidungen. Der Agent erfasst Bildschirmframes über macOS Display-APIs (ScreenCaptureKit oder CoreGraphics), verarbeitet die Bilder mittels GPU-beschleunigter Vision-Modelle zur Identifizierung von UI-Elementen und deren Zuständen und führt dann Aktionen (Klicks, Tastendrücke, Texteingabe) basierend auf dem aktuellen visuellen Kontext aus. Dieser Ansatz spiegelt wider, wie ein menschlicher Operator mit dem System interagieren würde: beobachten, entscheiden, handeln, verifizieren.

Umgang mit dynamischen UI-Zuständen

Wenn OpenClaw auf eine Aufgabe wie „Build das Projekt in Xcode und lade zu TestFlight hoch, falls erfolgreich" trifft, folgt es keinem festen Skript. Stattdessen führt es eine Schleife aus: aktuellen Bildschirm erfassen, identifizieren, in welchem Zustand sich das System befindet (z. B. „Xcode indexiert", „Build läuft", „Build erfolgreich", „Upload-Dialog offen"), die nächste Aktion basierend auf diesem Zustand wählen (z. B. auf Indexierungs-Abschluss warten, Build-Fortschritt überwachen, Upload-Button klicken, falls Build erfolgreich) und verifizieren, dass die Aktion erfolgreich war, bevor fortgefahren wird. Falls ein unerwarteter Dialog erscheint – beispielsweise eine macOS-Datenschutz-Aufforderung zur Bildschirmaufnahme-Berechtigung – kann der Agent den Dialog visuell erkennen, den korrekten Button („Erlauben") auswählen und die Hauptaufgabe fortsetzen. Diese Anpassungsfähigkeit ist kritisch in Remote-Rechenszenarien, wo der Systemzustand weniger vorhersehbar ist als auf einer lokalen Entwicklungsmaschine.

Technische Architektur: Warum M4-Hardware entscheidend ist

OpenClaws Vision-Pipeline hängt von latenzarmer Bildschirmaufnahme und GPU-beschleunigter Bildverarbeitung ab. Auf einem VPSMAC Bare-Metal M4-Knoten hat der Agent direkten Zugriff auf den Display-Buffer und Apples Metal-Framework, was hochfrequente Screen-Captures (bis zu 60 FPS) und Echtzeit-Inferenz auf GPU-basierten Vision-Modellen ohne signifikanten CPU-Overhead ermöglicht. Im Gegensatz dazu involviert der Display-Pfad in virtualisierten oder verschachtelten macOS-Umgebungen (wie macOS auf VMware oder Parallels) oft softwarebasierte Framebuffer-Emulation, die Latenz hinzufügt und Artefakte einführen oder Frameraten reduzieren kann. Diese Verzögerungen erschweren es dem Agenten, transiente UI-Zustände (z. B. einen kurzen „Build läuft"-Spinner) zu erkennen und können dazu führen, dass der Agent kritische visuelle Hinweise verpasst. Die Ausführung von OpenClaw auf physischer M4-Hardware stellt sicher, dass das Vision-System mit voller Genauigkeit arbeitet, was sich direkt in höherer Automatisierungs-Zuverlässigkeit niederschlägt.

Direkter Vergleich: Skript vs. Agent

Zur Quantifizierung der Unterschiede vergleichen wir, wie ein traditionelles Skript und OpenClaw drei gängige Remote-macOS-Automatisierungsaufgaben auf einem VPSMAC M4-Knoten handhaben.

| Szenario | Traditioneller Skript-Ansatz | OpenClaw KI-Agent Ansatz | Ergebnis |

|---|---|---|---|

| Xcode-Build mit dynamischer Indexierungszeit | Nutzt festes delay 60 vor Build-Befehl zum Warten auf Indexierung. Falls Indexierung länger dauert, schlägt Build-Befehl fehl. Falls Indexierung schneller ist, wartet Automatisierung unnötig. |

Agent überwacht Xcodes UI visuell auf „Indexierung abgeschlossen"-Indikator (Verschwinden des Indexierungs-Spinners oder Erscheinen des „Ready"-Status). Fährt sofort fort, wenn bereit, oder wartet so lange wie nötig. | Agent gewinnt: Passt sich variabler Indexierungszeit an (15s bis 120s in Testläufen), spart Zeit und eliminiert Fehlalarme. |

| Umgang mit unerwarteten System-Dialogen | Skript hat keine Logik zur Erkennung oder Schließung von Dialogen, die nicht im ursprünglichen Code vorgesehen sind. Falls ein „Software-Update verfügbar"- oder „Xcode Dateizugriff erlauben?"-Prompt erscheint, hängt Skript oder beendet sich. | Agent erkennt den Dialog per Vision (erkennt System-Prompt-Layout und Button-Labels), klickt „Nicht jetzt" oder „Erlauben" je nach Kontext und setzt den primären Workflow fort. | Agent gewinnt: Setzt Automatisierung trotz unerwarteter Interrupts fort. Skript erfordert manuelle Intervention oder zusätzliche defensive Code-Pfade, die schwer zu antizipieren sind. |

| App-Store-Einreichung mit variablem UI-Flow | Skript navigiert App Store Connect Einreichungsschritte über Accessibility-Pfad (z. B. button 3 of group 2 of window 1). Falls Apple die UI aktualisiert oder einen neuen Compliance-Screen hinzufügt, bricht Skript ab. |

Agent identifiziert jeden Screen visuell (z. B. „What's New"-Eintrag, Screenshot-Upload, Preisgestaltung, Compliance-Fragen) und navigiert basierend auf Inhalt und Kontext, nicht auf festen Pfaden. Falls ein neuer Screen erscheint, kann Agent ihn erkennen und entweder handhaben oder zur menschlichen Überprüfung markieren. | Agent gewinnt: Passt sich UI-Änderungen ohne Code-Updates an. Skript erfordert Wartung bei jeder UI-Änderung. |

Performance- und Zuverlässigkeits-Metriken

In einer Testserie auf VPSMAC M4-Knoten haben wir eine vollständige iOS Build-and-Deploy-Pipeline (Repository klonen, in Xcode bauen, UI-Tests ausführen, zu TestFlight hochladen) sowohl mit einem traditionellen Shell + AppleScript Workflow als auch mit OpenClaw automatisiert. Jeder Ansatz lief 50 Mal unter variierenden Bedingungen: sauberer Systemzustand, ausstehende macOS-Updates, Xcode-Versions-Updates und simulierte Netzwerklatenz. Ergebnisse:

Traditionelle Skript-Erfolgsrate: 68% (34 von 50 Läufen abgeschlossen ohne manuelle Intervention)

Häufige Fehlerursachen: Xcode-Indexierungs-Timeout (8 Fehler), unerwarteter System-Dialog blockiert Skript (6 Fehler), UI-Element-Pfad geändert nach Xcode-Update (2 Fehler).

OpenClaw Agent-Erfolgsrate: 94% (47 von 50 Läufen abgeschlossen ohne manuelle Intervention)

Fehlerursachen: Netzwerk-Disconnect während TestFlight-Upload (2 Fehler), Apple-ID-Session abgelaufen während Upload (1 Fehler). Alle Fehler aufgrund externer Faktoren, nicht UI-Anpassungs-Probleme.

Durchschnittliche Ausführungszeit (Skript): 42 Minuten pro Lauf (inkl. fester Wartezeiten und Wiederholungen)

Durchschnittliche Ausführungszeit (OpenClaw): 31 Minuten pro Lauf (Agent passt Wartezeiten an tatsächlichen Systemzustand an)

Der Agent erreichte nicht nur höhere Zuverlässigkeit, sondern reduzierte auch die Gesamtausführungszeit um 26%, indem er unnötige feste Delays eliminierte. Über Hunderte von Builds hinweg führt diese Zeitersparnis zu signifikanter Compute-Kostenreduktion auf gemieteten M4-Knoten.

Fehlerbehandlung: Vergleich der Resilienz

Wenn Automatisierung fehlschlägt, ist die Wiederherstellungsstrategie entscheidend. Traditionelle Skripte bieten typischerweise binäre Ausgänge: Erfolg oder Exit-with-Error. Das Debuggen eines fehlgeschlagenen Skripts erfordert die Überprüfung von Logs (falls Logging implementiert ist), die Reproduktion des Fehlers und die Modifikation des Codes. In Remote-Szenarien bedeutet dies, den gesamten Workflow erneut auszuführen, was zusätzliche Knoten-Stunden verbraucht und die Iteration verzögert.

OpenClaws Architektur unterstützt anspruchsvollere Fehlerbehandlung. Da der Agent ein Task-Modell (das Oberziel: „bauen und deployen") getrennt vom Ausführungsplan (die spezifischen ausgeführten Aktionen) pflegt, kann er Aktionen wiederholen, alternative UI-Pfade erkunden und erst an einen menschlichen Operator eskalieren, wenn alle bekannten Wiederherstellungsstrategien erschöpft sind. Falls der Agent beispielsweise dreimal versucht, den „Build"-Button zu klicken und der Button deaktiviert bleibt, kann er folgern, dass Xcode nicht bereit ist und zu einer Warten-und-Beobachten-Schleife wechseln. Falls ein Build fehlschlägt, kann der Agent die Fehlermeldung aus Xcodes Issue-Navigator erfassen, zur Überprüfung loggen und entscheiden, ob er mit einem sauberen Build-Ordner wiederholen oder den Fehler sofort melden soll. Dieses Niveau bedingter Logik ist in Skripten möglich, erfordert aber umfangreiche defensive Programmierung und Zustandsverfolgung, die Skripte komplex und schwer wartbar macht.

Warum Remote-Umgebungen den Unterschied verstärken

Auf einer lokalen Entwicklungsmaschine können Ingenieure eine gewisse Automatisierungs-Fragilität tolerieren, da sie anwesend sind, um einzugreifen, wenn Skripte fehlschlagen. Im Gegensatz dazu werden Remote-VPSMAC-Knoten typischerweise für unbeaufsichtigte Automatisierung genutzt: nächtliche Builds, Continuous-Integration-Pipelines oder Batch-Processing außerhalb der Arbeitszeiten. In diesen Szenarien negiert jeder Fehler, der manuelle Intervention erfordert, den Wert der Automatisierung und verursacht zusätzliche Kosten (verschwendete Knoten-Zeit) und Verzögerung (Warten bis zum nächsten Arbeitstag zum Beheben und Wiederholen). Die höhere Zuverlässigkeit und Anpassungsfähigkeit von KI-Agenten übersetzt sich direkt in höhere Auslastung gemieteter Rechenressourcen und schnellere Iterationszyklen.

Zusätzlich führen über VNC oder SSH zugängliche Remote-Knoten Latenz und Display-Eigenheiten ein, für die traditionelle Skripte nicht ausgelegt sind. Netzwerk-Lag kann dazu führen, dass Klicks außer der Reihe empfangen werden oder Input-Felder nicht wie erwartet den Fokus erhalten. Vision-basierte Agenten können diese Probleme visuell erkennen (z. B. Cursor nicht an erwarteter Position, Dialog erschien nicht innerhalb angemessener Zeit) und wiederholen oder anpassen, während Skripte sofortige, deterministische Antwort auf Befehle annehmen.

Wann Skripte vs. KI-Agenten einzusetzen sind

Trotz der Vorteile von KI-Agenten haben traditionelle Skripte weiterhin valide Anwendungsfälle. Für einfache, hochfrequente Aufgaben mit minimaler UI-Interaktion – wie das Ausführen eines Builds über Xcodes Kommandozeilen-Tool xcodebuild, das die GUI vollständig umgeht – ist ein Shell-Skript schneller, leichter und einfacher zu auditieren. Skripte sind auch vorzuziehen, wenn der Automatisierungs-Workflow vollständig deterministisch und unwahrscheinlich zu ändern ist, oder wenn der Overhead eines vision-basierten Agenten (GPU-Nutzung, Screen-Capture-Latenz) nicht durch die Komplexität der Aufgabe gerechtfertigt ist.

KI-Agenten glänzen in Szenarien, wo:

- Der Workflow komplexe UI-Navigation mit mehreren Verzweigungspfaden umfasst (z. B. App-Store-Einreichung mit bedingten Compliance-Screens)

- Der Systemzustand dynamisch oder unvorhersehbar ist (z. B. Warten auf Xcode zum Abschluss einer variablen Operation, Handhabung beliebiger System-Dialoge)

- Die UI sich häufig aufgrund von App- oder OS-Updates ändert und Skript-Code-Wartung kostspielig ist

- Die Automatisierung unbeaufsichtigt auf Remote-Hardware laufen muss, wo manuelle Intervention teuer oder unmöglich ist

Best Practices: Kombination beider Ansätze

Die robustesten Automatisierungsstrategien kombinieren oft Skripte und Agenten. Nutzen Sie Skripte für deterministische, Headless-Aufgaben (Repositories klonen, xcodebuild ausführen, Artefakte über Kommandozeilen-Tools hochladen) und delegieren Sie UI-getriebene Workflows an den Agenten (Xcode-Schemas einrichten, mit Simulator interagieren, App Store Connect Web-UI navigieren). Dieser Hybrid-Ansatz minimiert die Arbeitslast des Agenten, reduziert GPU- und CPU-Nutzung, während hohe Zuverlässigkeit für Aufgaben erhalten bleibt, die visuelle Rückmeldung und adaptive Entscheidungsfindung erfordern.

Beispielsweise könnte eine vollständige CI-Pipeline auf einem VPSMAC-Knoten folgendermaßen aussehen:

Deployment auf VPSMAC: Empfohlene Konfiguration

Zur Ausführung von OpenClaw auf einem VPSMAC Bare-Metal M4-Knoten mit optimaler Performance konfigurieren Sie den Knoten wie folgt:

- Display: Aktivieren Sie ein virtuelles Display oder verbinden Sie sich per VNC mit dem Knoten, um sicherzustellen, dass eine Display-Session aktiv ist. OpenClaw benötigt eine aktive grafische Session zur Erfassung von Screen-Frames.

- Screen-Capture-Berechtigungen: Erteilen Sie OpenClaw Bildschirmaufnahme-Berechtigung über Systemeinstellungen → Datenschutz & Sicherheit → Bildschirmaufnahme. Dies ist für ScreenCaptureKit-Zugriff erforderlich.

- GPU-Zugriff: Stellen Sie sicher, dass keine anderen GPU-intensiven Prozesse (z. B. ML-Training, Rendering) gleichzeitig laufen, da sie um GPU-Ressourcen konkurrieren und die Vision-Inferenz des Agenten verlangsamen können.

- Netzwerkstabilität: Nutzen Sie nach Möglichkeit eine kabelgebundene Ethernet-Verbindung oder einen stabilen Wi-Fi-Link, um Latenz in VNC- oder SSH-Sessions zu minimieren. Hohe Latenz bricht den Agenten nicht, kann aber Task-Ausführung verlangsamen.

- Session-Persistenz: Führen Sie OpenClaw innerhalb einer

tmux- oderscreen-Session aus, damit Automatisierung auch bei SSH-Verbindungsabbruch fortgesetzt wird.

Mit diesem Setup kann OpenClaw 24/7 auf dem M4-Knoten laufen und geplante Workflows ausführen, ohne Ihre lokale Entwicklungsmaschine zu binden. Kombinieren Sie dies mit VPSMACs stündlichem Abrechnungsmodell und Sie haben eine flexible, kosteneffiziente Automatisierungsplattform, die mit Ihrer Arbeitslast skaliert.

Datenschutz und Compliance-Überlegungen

Bei der Implementierung von KI-gestützter Automatisierung in Produktionsumgebungen – insbesondere in regulierten Branchen oder bei Verarbeitung personenbezogener Daten – sind GDPR-Konformität und Datenschutz-Anforderungen zu berücksichtigen. VPSMAC-Knoten können in EU-Rechenzentren bereitgestellt werden, um Data-Residency-Anforderungen zu erfüllen. Stellen Sie sicher, dass OpenClaw-Workflows keine sensiblen Daten außerhalb Ihrer definierten geografischen Grenzen übertragen. Implementieren Sie Verschlüsselung für Daten im Transit (SSH, VNC über TLS) und im Ruhezustand (verschlüsselte Volumes auf M4-Knoten). Protokollieren Sie alle automatisierten Aktionen für Audit-Trails und konfigurieren Sie Zugriffskontrolle über SSH-Keys und VPN-Zugriff, um unbefugten Zugriff zu verhindern.

Fazit: Vision-basierte Agenten als neuer Standard

Traditionelle skript-basierte Automatisierung auf macOS wird weiterhin eine Rolle für einfache, deterministische Aufgaben spielen, aber für komplexe, UI-getriebene Workflows – insbesondere in Remote-, unbeaufsichtigten Szenarien – repräsentieren KI-Agenten wie OpenClaw eine Stufenfunktions-Verbesserung in Zuverlässigkeit, Anpassungsfähigkeit und Wartbarkeit. Durch Nutzung von Computer Vision zur Wahrnehmung des Systemzustands und adaptiver Logik zur Navigation dynamischer UI-Flows eliminieren Agenten die Fragilität, die skript-basierte Automatisierung lange geplagt hat. Auf VPSMACs Bare-Metal M4-Hardware, wo latenzarmer GPU-Zugriff und stabile Display-Pipelines garantiert sind, liefern diese Agenten produktionsreife Performance. Für unabhängige Entwickler, kleine Teams und Unternehmen, die automatisierte iOS-Pipelines betreiben, ist die Kombination von VPSMAC-Rechenleistung und OpenClaw-Automatisierung ein technischer Vorteil, der direkt Kosten reduziert, Iteration beschleunigt und Zuverlässigkeit verbessert. Die Zukunft der Remote-macOS-Automatisierung sind nicht komplexere Skripte – es sind intelligentere Agenten, die sehen und sich anpassen.