2026 OpenClaw avec Ollama sur Mac cloud : configuration fournisseur, sondes et repli cloud budgété

Qui souffre et quoi casse : les équipes qui font déjà tourner OpenClaw avec des clés API hébergées veulent Ollama sur le même hôte Mac pour réduire la latence et maîtriser la dépense, mais la production bascule vite dans des états de réflexion interminables, des HTTP 500 opaques et des débats stériles sur la culpabilité de Slack ou du gateway.Ce que vous emportez : un tableau colocalisé contre séparé, des étapes concrètes pour l’URL de base et les chaînes de modèle, des plafonds de délai et de nouvelle tentative, un fournisseur cloud secondaire comme repli plafonné, et un ordre de triage doctor en premier.Plan de lecture : liste numérotée des douleurs, deux matrices, sept étapes opérables, métriques réutilisables en revue, un paragraphe de continuité sur l’intérêt du Mac cloud bare metal face à Windows bricolé ou macOS imbriqué, puis FAQ et JSON-LD HowTo. Les clés exactes suivent les notes de version OpenClaw que vous déployez.

Dans ce guide

1. Résumé : gateway, Ollama et clés cloud

Le gateway OpenClaw concentre routage, outils et canaux instantanés ; les modèles viennent d’API hébergées ou d’une surface HTTP locale. Ollama écoute en pratique sur 127.0.0.1:11434 avec des points de terminaison compatibles chat. Les erreurs coûteuses sont mécaniques : chaîne UI différente de ollama list, ou gateway conteneurisé résolvant localhost vers lui-même plutôt que l’hôte qui exécute ollama serve. Des timeouts plus courts que le froid du modèle donnent des faux négatifs. Traitez la config fournisseur en infrastructure en code : URL de base, identifiants de modèle et paliers de délai versionnés avec les manifestes du gateway. Ce guide suppose SSH vers un Mac cloud Apple Silicon avec gateway de référence ; l’objectif est un runbook local d’abord plus repli cloud, pas un bricolage ponctuel.

2. Points de friction : ports, noms, délais, canaux

Les fils de support se regroupent autour de quatre thèmes récurrents :

- Décalage d’adresse d’écoute : Ollama limité à la boucle locale pendant que le gateway tourne en réseau pont, ou exposition publique accidentelle des ports d’inférence sans authentification.

- Dérive des chaînes de modèle : absence de

:latest, mauvais préfixe de registre ou erreur de casse ; les 404 remontent dans les canaux comme du silence. - Délai face à la file : plusieurs sessions concurrentes sur un nœud 7×24 étirent la profondeur de file ; des échéances HTTP agressives sautent avant la fin du chargement des poids.

- Trous dans la politique de repli : sans fournisseur secondaire, panne dure pour les utilisateurs ; un repli cloud non contraint pendant un incident inverse l’économie attendue.

L’hygiène opérationnelle pèse autant que le YAML. Faites tourner les clés des replis cloud comme les secrets base de données ; annotez chaque incident avec le fournisseur réel pour la finance. Sur un nœud Mac partagé en SSH, planifiez les montées Ollama : une mise à jour silencieuse peut changer liaison par défaut ou tokenizer sur de longs fils.

3. Matrice topologique : Ollama colocalisé ou séparé

| Dimension | Ollama colocalisé au gateway | Ollama sur hôte distinct |

|---|---|---|

| Latence | Boucle locale ou pont hôte, RTT minimal | IP privée stable ou DNS de service requis |

| Isolation | Niveau processus ; adapté au Mac cloud mono-locataire | Séparation du rayon d’explosion ; charge ops plus élevée |

| Exposition | Ne jamais publier 11434 brut sur Internet | Restreindre les groupes de sécurité aux sources gateway |

| Débogage | Un curl local suffit | Traces multi-segments, mTLS possible |

| Adéquation | PoC jusqu’à concurrence moyenne | Équipes plateforme séparant modèles gourds en GPU |

Si Ollama vit sur un second Mac ou une machine GPU, préférez le RFC1918 et des règles de pare-feu explicites aux tunnels SSH ad hoc. Notez le sous-réseau sortant du gateway et l’obligation mTLS ; des magasins TLS désalignés imitent une régression de modèle quand le gateway retente sur un chemin dégradé.

4. Sept étapes : de la config vide au repli prêt

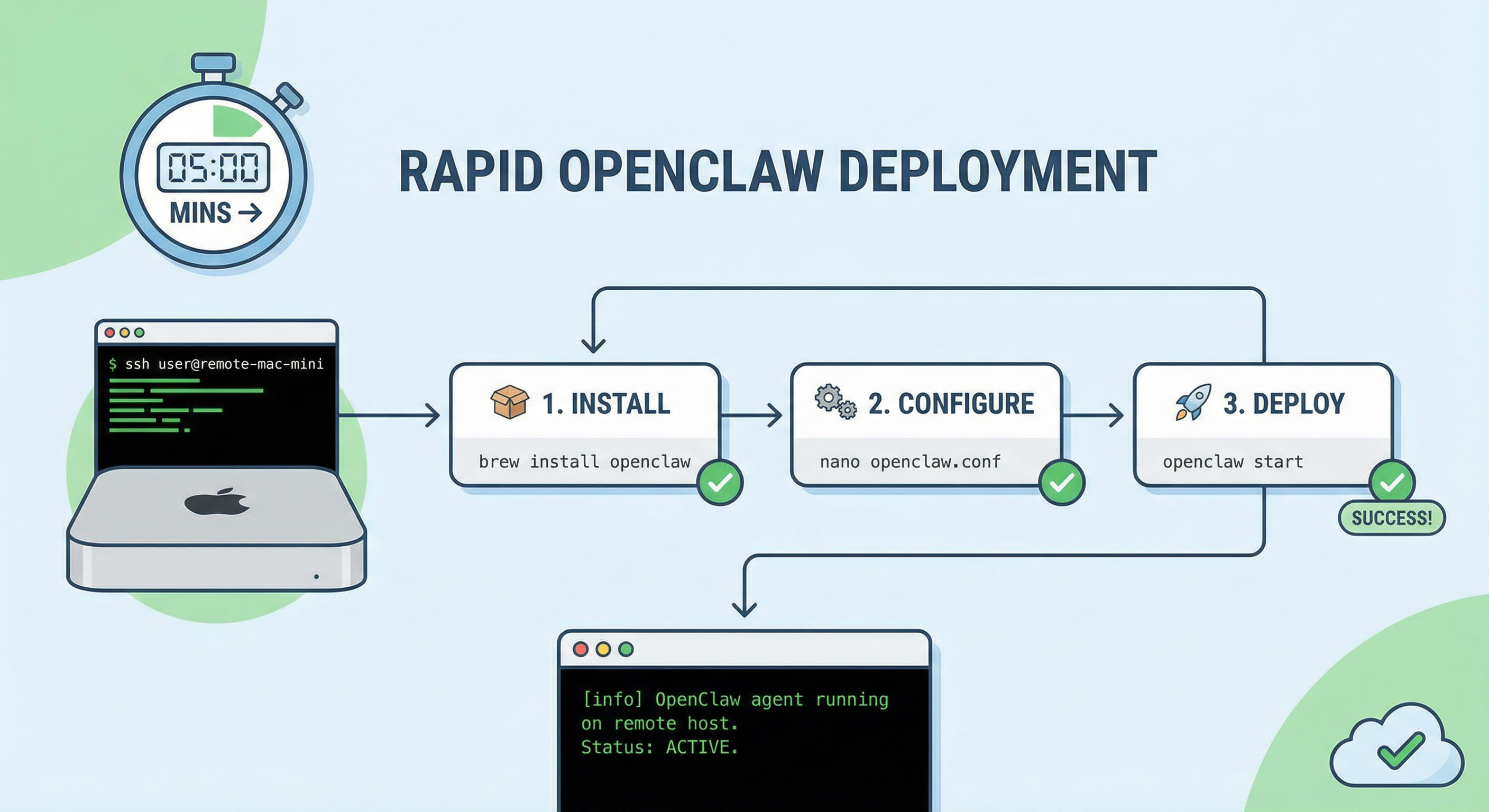

- Installer et tirer les modèles : vérifier avec

ollama --version, tirer les poids, capturer les noms exacts viaollama list. - Sonde de disponibilité : interroger

http://127.0.0.1:11434/api/tagsou la route de santé documentée pour votre version. - Enregistrer le fournisseur local dans le gateway : définir l’URL de base adaptée au réseau conteneur, la chaîne de modèle et l’usage éventuel de couches compatibles OpenAI.

- Superposer les délais : séparer plafonds de connexion, premier octet et fin de requête pour absorber le froid sans affamer les battements de cœur des canaux.

- Ajouter le repli cloud : configurer un fournisseur hébergé secondaire avec plafonds de jetons ou de dépense par incident.

- Superviser les processus : utiliser

launchdou un ordre équivalent pour que Ollama démarre avant que le gateway n’accepte le trafic ; brancher la rotation des journaux. - Valider : lancer trois invites identiques, mesurer le délai jusqu’au premier jeton et le taux d’erreur, puis ajouter des sessions concurrentes pour observer la mise en file.

Commandes de fumée rapides :

Après câblage, lancez une charge synthétique qui reflète votre canal le plus sollicité : Q/R courtes, longues synthèses, tours outillés si activés. Séparez p50 et p95 jusqu’au premier jeton : la médiane flatte les démos, l’astreinte vit la queue. Toute surface hors boucle locale doit passer par TLS derrière proxy inverse, mTLS ou listes IP ; un 11434 public attire mineurs et fuites.

5. Métriques : mémoire, concurrence, délais

Employez ces ordres de grandeur dans les dossiers de dimensionnement ; recroisez toujours avec la quantification exacte que vous déployez :

- Mémoire unifiée : un modèle 7B en Q4 réclame souvent de l’ordre de cinq à six gigaoctets de poids résidents ; gateway, greffons et second modèle sur trente-deux gigaoctets ou moins invitent au swap sous rafales de chat.

- Modèle de concurrence : traitez l’inférence locale comme une file finie. Un schéma courant est un modèle local actif unique avec débordement cloud plutôt que des jobs locaux parallèles illimités.

- Budget de délai : prévoyez des dizaines de secondes pour le premier jeton au démarrage à froid ; si le p95 à régime reste au-dessus des exigences produit, réduisez taille de modèle ou concurrence avant de baisser les timeouts pour masquer la latence.

- Hygiène disque : plusieurs versions de modèle consomment des dizaines de gigaoctets ; couplez

ollama rmà des alertes disque sur les nœuds Mac loués. - Observabilité : journalisez nom de modèle, durée et déclenchement du repli par requête pour que la finance compare économies et disponibilité.

- Budget fiabilité : lorsque le swap augmente, les phases de liaison s’étirent même si le processeur semble oisif ; corrélez avec

vm_statavant d’accuser la pile LLM.

Incluez le trafic saisonnier : campagnes et ponts d’incident multiplient les sessions plus vite que les moyennes journalières. Gardez un petit modèle froid dans le gateway pour basculer pendant tirages de poids ou ménage disque sans ouvrir le robinet cloud. Si vous colocalisez d’autres services, documentez watts et thermique : Apple Silicon tient jusqu’à ce qu’une charge toutes cœurs croise un flux d’air insuffisant.

6. Dépannage : doctor, journaux, FAQ canaux

Suivez une échelle fixe : openclaw doctor, journaux du gateway à l’horodatage du message, santé du processus Ollama, puis règles de jumelage des canaux. Si les utilisateurs voient une réflexion sans réponse, vérifiez si la requête HTTP s’est terminée ; si la réponse HTTP est valide mais le chat vide, inspectez quotas et politiques de mention. Utilisez la matrice symptômes ci-dessous dans les post-mortems.

| Symptôme | Vérifier d’abord | Puis vérifier |

|---|---|---|

| 404 immédiat | Chaîne de modèle contre ollama list | URL de base ou localhost conteneur |

| Timeout intermittent | Démarrage à froid et profondeur de file | Swap et pression disque |

| Silence canal | Erreurs outil avalées par le gateway | Webhook ou portée du bot |

| Pic de facture après repli | Rafales de nouvelles tentatives vers le cloud | Plafonds manquants sur la fenêtre de repli |

macOS sur Windows générique ou virtualisation non licenciée achète du matériel bon marché au prix d’une dette de compatibilité. Docker seul ajoute UID de volumes et DNS qui ne se voient qu’en 7×24. Pour vecteurs Apple Silicon, launchd natif et une seule surface SSH OpenClaw plus Ollama, un Mac cloud dédié bat souvent l’empilement fragile. Les guides VPSMAC rapprochent le provisionnement d’une API de VPS.

Répétez les défaillances chaque trimestre : tuer Ollama, saturer le disque, révoquer une clé cloud ; vérifiez alertes et plafonds de repli. Les exercices de table évitent les angles morts en panne. Documentation, métriques et drills alignés transforment l’inférence locale en service facturable et presque ennuyeux.