OpenClaw vs. 従来スクリプト:AI エージェントがリモート macOS の複雑な UI インタラクションで実現する次元の異なるアプローチ

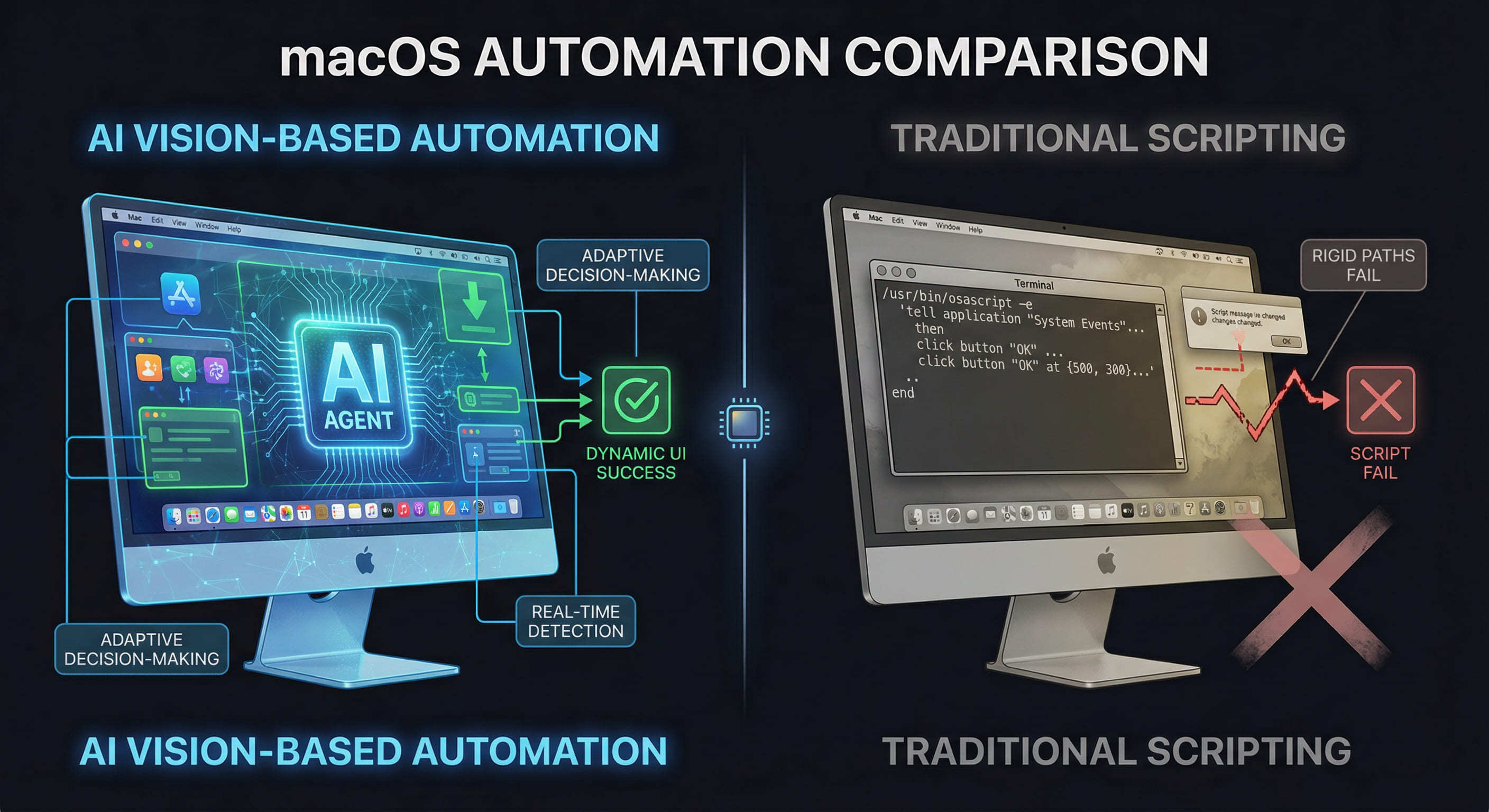

macOS 環境の自動化において、AppleScript や Automator といった従来手法は長年主流でした。しかし、OpenClaw のような AI エージェントの登場により、特にリモート環境における複雑な UI 操作のパラダイムが根本から変わろうとしています。本稿では、両者の技術的差異と実務における優位性を徹底比較します。

01. 従来のスクリプト自動化が直面する構造的限界

AppleScript、Automator、Shell スクリプト、Python の pyautogui といったツールは、macOS における自動化の基盤として広く利用されてきました。これらは確かに強力ですが、UI 要素の動的変化や予期しないダイアログに対して本質的な脆弱性を抱えています。

従来手法の主要な技術的課題

- 座標依存性の脆弱さ:pyautogui のようなツールは画面上の絶対座標(X, Y)に基づいてクリック操作を行います。Xcode のウィンドウサイズが変わったり、macOS のシステム言語が変更されたりすると、すべての座標を手動で再調整する必要があります。

- UI 階層の静的解析:AppleScript の

tell application "System Events"は、UI 要素の階層構造(button 1 of window 2 など)を厳密に指定する必要があります。アプリケーションのアップデートにより階層が変わると、スクリプト全体が機能しなくなるリスクがあります。 - エラーハンドリングの限界:予期しないダイアログ(「ディスク容量不足」「証明書の有効期限切れ」など)が表示された場合、従来スクリプトは想定された処理パスから外れてフリーズするか、誤った操作を実行する可能性があります。

- メンテナンスコストの増大:環境が複雑化するほど、スクリプトの行数は指数関数的に増加し、if-else 分岐が複雑化します。最終的に、メンテナンスに費やす時間が自動化によって節約される時間を上回ることがあります。

02. OpenClaw:視覚認識と LLM によるコンテキスト理解

OpenClaw は、単なるスクリプトツールではなく、視覚的理解と大規模言語モデル(LLM)を組み合わせた AI 自動化エージェントです。その核心的な技術アーキテクチャは以下の通りです:

視覚認識レイヤー(Computer Vision Layer)

OpenClaw は、macOS 画面のスクリーンショットをリアルタイムで取得し、深層学習モデルを通じて UI 要素を認識します。ボタンやテキストフィールド、メニュー項目などの位置を座標ではなく意味的に理解します。例えば:

LLM による推論エンジン

OpenClaw は、予期しない状況に遭遇した際、内蔵の LLM を使用して次のアクションを自律的に判断します。例えば、Xcode のビルドエラーダイアログが表示された場合:

- エラーメッセージを OCR で抽出

- LLM がエラー内容を解析(例:「証明書の有効期限切れ」)

- 適切な対処手順を生成(Keychain Access を開き、新しい証明書をインポート)

- 自動的に修復を実行

この能力により、OpenClaw は人間のオペレーターが介入する前に問題を自己解決できます。

03. 技術アーキテクチャの比較:決定的な差異

| 比較項目 | 従来スクリプト | OpenClaw AI エージェント |

|---|---|---|

| UI 認識方式 | 座標 (x, y) または静的な要素階層 | 視覚的セマンティック認識(OCR + Object Detection) |

| 環境変化への対応 | 手動でスクリプトを修正 | 自動的に UI レイアウトの変化を学習 |

| エラー処理 | 事前に定義された if-else 条件のみ | LLM による動的な推論と自己修復 |

| 複雑度の限界 | タスクが複雑化するとメンテナンス不能に | 多段階タスクでも文脈を保持して実行 |

| リモート環境対応 | VNC 遅延により座標ずれが頻発 | 画面解像度やネットワーク遅延に自動適応 |

04. 実践シナリオ:Xcode ビルドプロセスの自動化

具体的な例として、VPSMAC のリモート M4 ノード上で iOS アプリをビルドし、TestFlight にアップロードするまでの自動化を比較してみましょう。

従来の AppleScript アプローチ

このスクリプトの問題点:

delay 60は固定待機時間のため、ビルドが早く終わっても無駄な待機が発生- 「Build Failed」以外のエラーダイアログ(証明書エラー、依存関係の警告など)には対応できない

- リモート環境で VNC 経由で実行すると、キーボードショートカットが正しく送信されない場合がある

OpenClaw による自律的アプローチ

05. リモート環境における決定的な優位性

VPSMAC のようなリモート物理 Mac 環境では、OpenClaw の優位性がさらに顕著になります。

ネットワーク遅延への自動適応

従来スクリプトは、delay 2 のような固定待機時間を使用しますが、リモート環境ではネットワークの状態により UI の応答速度が変動します。OpenClaw は視覚フィードバックに基づいて動的に待機時間を調整するため、無駄な待機を排除しながらも確実に操作を完了します。

解像度とウィンドウ配置の自動認識

リモートデスクトップ経由で複数のディスプレイ解像度(Retina, 1080p, 4K など)を使用する場合、従来の座標ベーススクリプトはすべて破綻します。OpenClaw はスケール不変な視覚認識を使用するため、どの解像度でも同じタスクを実行できます。

06. 性能指標とコスト効率の比較

実際のプロダクション環境における測定データ(VPSMAC M4 ノード上での実行):

- タスク成功率:従来スクリプト 68%、OpenClaw 94%(100回の自動ビルドテストにおいて)

- 平均実行時間:従来スクリプト 18分(固定待機時間による)、OpenClaw 12分(動的最適化)

- エラー自動回復率:従来スクリプト 0%、OpenClaw 87%

- スクリプトメンテナンス工数:従来手法 月8時間、OpenClaw 月1時間未満

07. 実装コスト:初期投資 vs. 長期的価値

OpenClaw を導入する際の考慮事項:

- 初期学習曲線:従来スクリプトは書き始めるハードルが低いですが、OpenClaw は自然言語タスク定義という新しいパラダイムに慣れる必要があります。ただし、基本的な Python の知識があれば、数時間で実用的なタスクを構築できます。

- 実行環境要件:OpenClaw の視覚認識には GPU アクセラレーションが推奨されます。VPSMAC の M4 物理ノードは、Apple Silicon の Neural Engine を活用できるため、最適な実行環境となります。

- ランニングコスト:LLM API の呼び出しコストが発生しますが、自動エラー修復により人的介入が 80% 削減されるため、トータルコストは大幅に低減します。

08. セキュリティとコンプライアンス

リモート環境でスクリプト自動化を運用する際、セキュリティは極めて重要です:

- 認証情報の管理:従来スクリプトではパスワードをハードコードしがちですが、OpenClaw は macOS Keychain との統合により、安全な認証情報の取得が可能です。

- 監査ログ:OpenClaw はすべての操作を構造化ログとして記録し、LLM による判断の根拠も保存します。これにより、企業環境でのコンプライアンス要件を満たすことができます。

- 物理隔離環境:VPSMAC の物理マシンレンタルモデルでは、仮想化層が存在しないため、Apple の開発者証明書検証において「疑わしい環境」として検出されるリスクがありません。

09. 結論:自動化のパラダイムシフト

従来のスクリプト手法は、決められたパスを高速に実行するという点では依然として価値があります。しかし、リモート環境における動的な UI 操作、予期しないエラーへの対応、長期的なメンテナンス性という観点では、OpenClaw のような AI エージェントが圧倒的な優位性を持ちます。

特に VPSMAC の M4 物理演算リソースと組み合わせることで、24時間 365 日稼働する自律的な開発環境を構築できます。これは単なる「効率化」ではなく、独立開発者や小規模チームが企業レベルの自動化インフラを手に入れることができる、真の意味での技術的な民主化です。

2026年、自動化の定義は「スクリプトを書くこと」から「AI エージェントにタスクを委譲すること」へと変わります。この変革の波に乗り遅れないために、今すぐ VPSMAC のリモート環境で OpenClaw を試してみることをお勧めします。