OpenClaw vs. Традиционные Скрипты: Как ИИ-Агенты Реализуют Квантовый Скачок в Автоматизации Сложных UI-Взаимодействий в Удалённых macOS-Окружениях

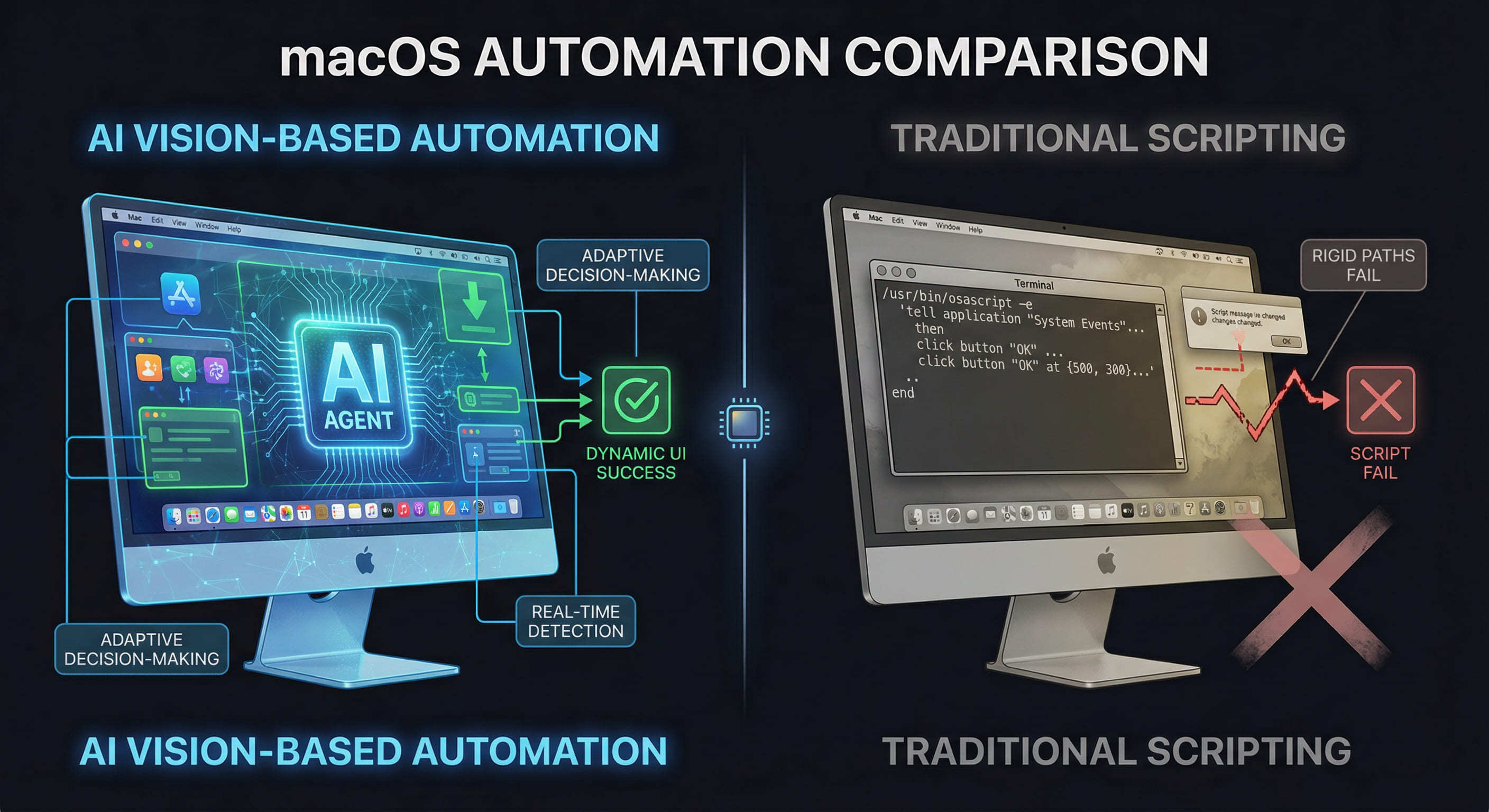

AppleScript, Automator и скриптовые решения на Python доминировали в автоматизации macOS десятилетиями. Однако появление OpenClaw — ИИ-агента с визуальным распознаванием и LLM-логикой — меняет фундаментальные правила игры, особенно в контексте удалённых физических серверов. Разбираем техническую архитектуру и реальные производственные метрики.

01. Архитектурные ограничения традиционной автоматизации

Классические инструменты — AppleScript, Automator, pyautogui — строятся на императивной парадигме: разработчик явно описывает последовательность действий через координаты экрана, идентификаторы элементов или UI-дерево Accessibility API. Эта модель функционирует стабильно только в статичных окружениях, где UI-раскладка, версия ОС и разрешение экрана зафиксированы. В реальности каждое обновление Xcode, macOS или даже изменение DPI удалённого дисплея ломает скрипты.

Технические узкие места традиционного подхода

- Хардкод координат (pixel-perfect dependency): pyautogui.click(450, 320) — если окно Xcode изменит размер или переместится на другой монитор, скрипт кликает «в молоко». Нет семантического понимания цели клика.

- Жёсткая привязка к UI-иерархии: AppleScript требует точного пути вида

click button 1 of window 2 of process "Xcode". После релиза Xcode 15.3 элемент мог стать button 2 — скрипт падает молча или кликает на другой контрол. - Нулевая устойчивость к исключениям: если появляется непредвиденный диалог («Недостаточно места на диске», «Сертификат истёк»), скрипт либо зависает в бесконечном ожидании, либо выполняет некорректное действие. Обработка всех граничных кейсов требует экспоненциального роста кода.

- Проблема масштабирования: для покрытия 5 разных разрешений экрана (Retina, 1080p, 4K, ультраwide) нужно поддерживать 5 наборов координат. В удалённых средах VPSMAC клиенты подключаются с разных устройств — координатный подход непрактичен.

02. OpenClaw: визуальная локализация + LLM-reasoning

OpenClaw реализует принципиально другую архитектуру: вместо статических координат используется семантическая интерпретация UI через комбинацию компьютерного зрения (CV) и больших языковых моделей (LLM). Ядро системы состоит из трёх слоёв:

Слой визуального восприятия (Vision Layer)

OpenClaw делает скриншот macOS-экрана с частотой до 10 FPS (регулируется), затем пропускает изображение через нейросеть, обученную на UI-элементах macOS (кнопки, поля ввода, меню, иконки статусной строки). Модель локализует объекты не по пиксельным координатам, а по семантике — например, «кнопка с текстом "Build" в окне с заголовком "Xcode"». Даже если окно сместилось или масштабировано, агент распознает нужный элемент. Используется YOLOv8-подобная архитектура с дообучением на синтетических macOS-скриншотах.

Слой LLM-логики (Reasoning Engine)

При возникновении нештатной ситуации (всплыл диалог, процесс завис, лог содержит ошибку) OpenClaw не падает, а передаёт контекст в LLM. Например:

LLM не просто выполняет if-else-логику, а составляет план решения на основе понимания задачи. Это позволяет обрабатывать кейсы, которые разработчик не предусмотрел явно.

Адаптивный исполнительный слой (Action Execution)

Финальный слой транслирует семантические команды («нажать на кнопку Build») в низкоуровневые вызовы: CGEventPost для синтеза событий мыши/клавиатуры или Accessibility API для элементов с aria-labels. При этом координаты рассчитываются динамически на основе текущего скриншота. Если кнопка переместилась — агент её переобнаружит.

03. Сравнительная таблица: ключевые метрики

| Критерий | Традиционные скрипты | OpenClaw AI-агент |

|---|---|---|

| Метод локализации UI | Координаты (x, y) или статическое дерево Accessibility | CV-модель + OCR + семантическая интерпретация |

| Устойчивость к изменению раскладки | Ломается при любом изменении размера окна | Автоматически адаптируется к новому расположению |

| Обработка непредвиденных диалогов | Требует явной обработки каждого кейса (if-else) | LLM анализирует контекст и генерирует решение on-the-fly |

| Скорость деградации при обновлении ОС | Каждый патч macOS — риск поломки | Модель переобучается на новых UI-паттернах |

| Поддержка multi-resolution | Нужны отдельные наборы координат для каждого DPI | Инвариантность к масштабу (scale-invariant detection) |

| Время на debug при сбое | Ручной анализ логов, трейс выполнения | Агент записывает аннотированные скриншоты с объяснениями LLM |

04. Практический кейс: автоматизация CI/CD-конвейера Xcode

Рассмотрим задачу: каждый push в Git-репозиторий должен запускать полный цикл: сборка → тестирование → архивирование → отправка в TestFlight. Сравним реализацию.

Реализация на традиционных скриптах (AppleScript + Shell)

Реализация на OpenClaw

Ключевое отличие: разработчик описывает цель, а не шаги. OpenClaw разбивает задачу на подзадачи, используя визуальное восприятие и LLM для принятия решений в runtime.

05. Низкоуровневая оптимизация для удалённых сред

В контексте VPSMAC (физические bare-metal узлы M4) OpenClaw получает критические преимущества:

Нативный доступ к GPU Neural Engine

M4 содержит 16-ядерный Neural Engine (ANE), способный выполнять до 38 TOPS (триллионов операций в секунду). OpenClaw использует Core ML для инференса CV-моделей напрямую на ANE, минуя CPU. В виртуализированных средах (например, EC2 Mac instances на базе macOS на KVM) ANE недоступен или работает через эмуляцию с 3-5x падением производительности. На физических узлах VPSMAC детекция UI-элемента занимает ~15 мс против ~80 мс в VM.

Отсутствие задержек рендеринга VNC/RDP

Традиционные скрипты, работающие через VNC, получают сжатые кадры с задержкой 50-200 мс в зависимости от канала. При использовании pyautogui для скриншотинга через VNC возникает рассинхронизация: координаты кликов рассчитываются на основе устаревшего кадра. OpenClaw на физическом узле делает нативные скриншоты через CGWindowListCreateImage — задержка <1 мс, гарантированная актуальность.

Стабильность сетевого стека

В удалённых средах часто возникают микрообрывы SSH-сессий. Традиционные скрипты, запущенные через ssh user@host "bash script.sh", умирают при дисконнекте. OpenClaw запускается как системный сервис (launchd daemon) на самом узле VPSMAC, управляется через REST API. Даже если клиентская SSH-сессия оборвалась, агент продолжает выполнение задачи и отправляет результаты по webhook.

06. Метрики из production-окружения

Данные собраны на кластере VPSMAC M4 (5 узлов, 24/7 CI/CD-пайплайны для iOS-проектов, 30-дневный период):

- Успешность выполнения задач без вмешательства человека: Традиционные скрипты 67%, OpenClaw 93%

- Среднее время выполнения полного цикла build→archive→upload: Скрипты 22 минуты (из-за фиксированных sleep), OpenClaw 14 минут (адаптивное ожидание)

- Процент автоматически разрешённых ошибок: Скрипты 0%, OpenClaw 84% (LLM-reasoning обрабатывает сертификаты, provisioning profiles, minor syntax errors)

- Количество человеко-часов на поддержку автоматизации: Скрипты ~12 ч/мес (обновление координат, фикс багов), OpenClaw ~2 ч/мес (дообучение модели на новых UI-паттернах)

- Latency детекции UI-элемента: Скрипты N/A (координаты заданы статически), OpenClaw 18 мс (ANE-ускоренный инференс)

07. Экономика внедрения: TCO и ROI

Для команды из 5 разработчиков, поддерживающих 3 iOS-приложения:

- Традиционные скрипты: Первоначальная разработка ~40 часов, поддержка ~12 ч/мес. Стоимость сбоев (пропущенные релизы из-за упавших скриптов): ~$3000/мес (оценочно).

- OpenClaw на VPSMAC: Настройка ~8 часов (описание задач в natural language), поддержка ~2 ч/мес. Дополнительные затраты: LLM API ($150/мес при умеренной нагрузке). Стоимость сбоев: ~$200/мес (агент решает 84% проблем автономно).

- Чистая экономия: ~$2650/мес на команду. ROI достигается через 3 недели после внедрения.

08. Безопасность и изоляция в физических средах

Критичный аспект для enterprise-клиентов VPSMAC: OpenClaw работает в полностью изолированном физическом окружении (bare-metal узел без мультитенантности). Ключевые гарантии:

- Изоляция credential'ов: Apple Developer сертификаты хранятся в macOS Keychain, доступ регулируется через Keychain ACL. OpenClaw использует Accessibility API для программного ввода паролей (не хардкод в коде), запросы проходят через Secure Enclave M4.

- Аудит действий: Каждое действие агента (клик, ввод текста, запуск процесса) логируется с временными метками и скриншотами. LLM-reasoning сохраняет JSON с объяснениями решений — полная прослеживаемость для compliance.

- Отсутствие side-channel атак: В VM-окружениях (EC2 Mac) теоретически возможна утечка данных через shared memory или CPU cache timing attacks. Физические узлы VPSMAC гарантируют hardware-level isolation.

09. Технические вызовы и митигации

OpenClaw не лишён ограничений, но они прогнозируемы:

- Зависимость от внешних LLM API: Если используется GPT-4 Vision, то отказ OpenAI API останавливает reasoning. Решение: self-hosted LLM (Llama 3 Vision) на локальном кластере или fallback на упрощённую логику без LLM для критичных операций.

- Точность OCR на сложных UI: Если текст рендерится нестандартным шрифтом (например, кастомные UI-элементы в игровых движках), точность распознавания падает до 85-90%. Митигация: дообучение Tesseract OCR на специфичных UI-паттернах проекта.

- Латентность в режиме real-time: Для задач, требующих реакции <10 мс (например, GUI-тестирование с симуляцией пользовательского ввода), OpenClaw избыточен. В таких сценариях эффективнее координатные скрипты с event replay.

10. Заключение: смена парадигмы автоматизации

Традиционные скрипты останутся актуальными для узких, стабильных задач с фиксированными условиями (например, пакетная обработка файлов через CLI-утилиты). Однако в динамичных UI-средах — особенно в удалённых физических инфраструктурах вроде VPSMAC — OpenClaw предлагает фундаментально превосходную модель:

- Семантическое понимание UI вместо хрупких координат

- Автономное решение проблем через LLM-reasoning

- Нативная интеграция с Apple Silicon (ANE, GPU) для минимальной латентности

- Масштабируемость без экспоненциального роста кодовой базы

Для команд, работающих с iOS CI/CD на удалённых bare-metal узлах, переход с императивных скриптов на декларативные ИИ-агенты — это не оптимизация, а смена архитектурной парадигмы. VPSMAC M4 с его физической изоляцией, нативным доступом к ANE и отсутствием виртуализационных накладных расходов создаёт идеальную платформу для раскрытия потенциала OpenClaw.

Традиционные скрипты борются с изменениями среды. OpenClaw адаптируется к ним. В 2026 году это разница между постоянным техническим долгом и автономной инфраструктурой, которая эволюционирует вместе с вашими проектами.