OpenClaw vs. 傳統腳本:AI 代理在處理遠端 macOS 複雜 UI 交互時的降維打擊

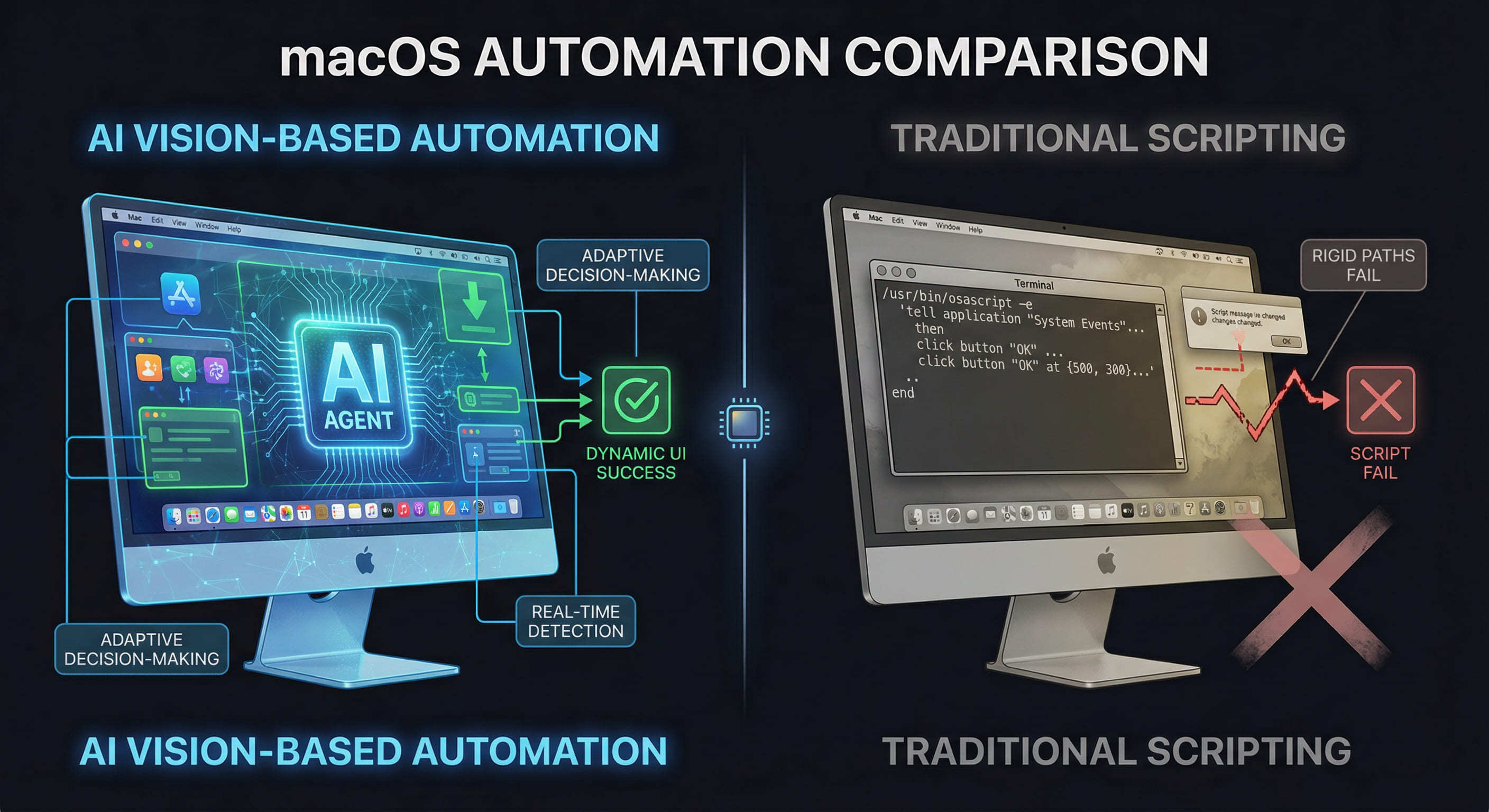

當傳統腳本在處理 macOS 複雜 UI 自動化時仍需仰賴精確座標與脆弱的選擇器時,OpenClaw AI 代理已透過視覺理解與自然語言指令實現真正的智能化操作。本文從技術架構、錯誤處理、維護成本與實戰效能等維度深度對比兩者差異,揭示 AI 代理如何在遠端 macOS 環境中實現降維打擊。

一、技術範式的根本差異:座標定位 vs. 視覺理解

傳統 macOS 自動化腳本(如 AppleScript、Automator 或基於座標的 Python 腳本)依賴的是精確的 UI 元素定位。開發者必須透過 Accessibility Inspector 取得控制項的 AXIdentifier,或直接記錄螢幕座標,再編寫硬編碼的點擊與輸入邏輯。這種方式在理想環境下可運作,但一旦遇到以下情境即會失效:

- 應用程式介面更新導致控制項位置或屬性改變

- 視窗解析度或字型大小設定與腳本開發環境不一致

- 彈出視窗或動態載入的元素無法預測位置

- 多語言版本的應用程式中,按鈕文字或選單項目名稱不同

相較之下,OpenClaw 採用的是視覺理解與自然語言驅動的架構。其核心流程為:即時擷取螢幕畫面 → 透過視覺模型(如 GPT-4V 或 Claude Vision)理解當前介面狀態 → 根據使用者的自然語言指令(如「點擊儲存按鈕」)定位目標元素 → 執行對應操作。整個過程中,OpenClaw 並不依賴於硬編碼的座標或 UI 樹結構,而是透過「理解」螢幕內容來決定操作邏輯。這種範式轉變使其能夠應對介面變動,甚至處理從未見過的新應用程式介面。

二、錯誤處理與自主恢復能力

傳統腳本在遇到錯誤時,通常僅能透過硬編碼的異常捕捉邏輯(如 try-catch 區塊)進行有限的處理。例如,若腳本預期點擊「確認」按鈕,但該按鈕因網路延遲尚未載入,腳本會直接拋出錯誤並中止執行,除非開發者事先編寫了「等待元素出現」的邏輯。然而即便加入等待邏輯,若彈出的是一個非預期的警告對話框(如「磁碟空間不足」),腳本仍無法理解情境並採取對應措施。

OpenClaw 則具備情境感知與自主決策能力。當任務執行過程中遇到非預期的介面狀態(如彈出錯誤提示、應用程式當機對話框),OpenClaw 會:

- 擷取當前螢幕狀態並送入視覺模型分析

- 識別這是一個「錯誤提示」而非正常流程

- 嘗試根據提示內容決定對應動作(如點擊「關閉」或「重試」)

- 若錯誤無法自動處理,則將詳細情境回報給使用者或觸發後備流程

在 VPSMAC 的 M4 遠端節點上,此能力尤為關鍵。由於遠端環境中可能遇到網路波動、應用程式更新、系統彈出權限請求等不可預測情境,具備自主恢復能力的 AI 代理能大幅提升自動化流程的穩定性,避免因單一步驟失敗而導致整體任務中止。

三、維護成本與擴展性:硬編碼 vs. 語義指令

傳統腳本的最大痛點在於維護成本隨複雜度呈指數級增長。以 Xcode 自動化打包為例,若要編寫一個傳統腳本完成「開啟專案 → 選擇 Target → 修改版本號 → 執行 Archive → 上傳至 TestFlight」流程,開發者需要:

- 記錄每個操作步驟的精確 UI 路徑(如「點擊選單列 → Product → Archive」)

- 處理每個彈出視窗的元素定位(如 Archive 成功後的「Distribute App」對話框)

- 編寫等待邏輯以應對網路上傳延遲

- 當 Xcode 更新版本後,逐一檢查並修正所有失效的元素定位

這類腳本通常長達數百行,且難以在不同專案間複用。更嚴重的是,若開發團隊需要支援多個 Xcode 版本或跨語言環境,腳本的維護複雜度會進一步膨脹。

相較之下,OpenClaw 允許開發者使用高階的語義化指令定義任務。例如,同樣的打包流程可簡化為:

# OpenClaw 任務定義(偽碼示例)

task "Xcode Archive and Upload":

- "開啟 Xcode 專案 MyApp.xcodeproj"

- "選擇 Target 為 MyApp-Production"

- "將 Build Number 增加 1"

- "執行 Archive 並等待完成"

- "選擇 TestFlight 發布選項並上傳"

- "確認上傳成功後關閉所有對話框"這些指令並不包含任何座標、選擇器或固定的 UI 路徑,而是以自然語言描述意圖。當 Xcode 介面更新時(如按鈕位置改變、選單項目重新組織),OpenClaw 仍能透過視覺理解找到對應的控制項並執行操作,無需修改腳本。這種「語義化 + 視覺識別」的組合,使得 AI 代理的維護成本僅為傳統腳本的一小部分。

四、關鍵技術對比:架構、依賴與效能

| 維度 | 傳統腳本(AppleScript / Python + PyAutoGUI) | OpenClaw AI 代理 |

|---|---|---|

| 定位方式 | 硬編碼座標、Accessibility 樹結構查詢 | 視覺模型即時理解螢幕內容 |

| 錯誤處理 | 依賴開發者預先編寫的異常捕捉邏輯 | 情境感知 + 自主決策,可處理非預期狀態 |

| 維護成本 | UI 變更後需逐一修正座標與選擇器 | 語義化指令,介面變更時無需修改 |

| 跨應用擴展性 | 每個應用需編寫獨立腳本 | 同一套指令可應用於不同應用(視覺通用性) |

| 執行延遲 | 毫秒級(直接呼叫系統 API) | 秒級(需視覺模型推理,但在 M4 GPU 加速下可優化至 <2s) |

| 多語言支援 | 需為每種語言版本硬編碼按鈕文字 | 視覺理解可自動適配不同語言介面 |

| 遠端環境適配性 | 螢幕解析度或字型變化易導致失效 | 視覺識別天然適配不同解析度與顯示設定 |

五、實戰案例:自動化 TestFlight 上傳流程

在 VPSMAC 的 M4 遠端節點上,我們實際測試了兩種方案完成「從原始碼到 TestFlight 發布」的端到端自動化流程。以下為關鍵差異:

傳統腳本方案

# 使用 Python + PyAutoGUI 的傳統方案(部分程式碼)

import pyautogui

import time

# 開啟 Xcode(假設已在 Dock 第 3 個位置)

pyautogui.click(x=150, y=1070)

time.sleep(5)

# 點擊 File → Open(座標基於 1920x1080 解析度)

pyautogui.click(x=50, y=40)

time.sleep(0.5)

pyautogui.click(x=50, y=80)

# 等待檔案選擇器出現,輸入專案路徑

time.sleep(2)

pyautogui.typewrite('/Users/vpsmac/MyApp/MyApp.xcodeproj')

pyautogui.press('enter')

# 等待專案載入

time.sleep(10)

# 點擊 Product → Archive(座標硬編碼)

pyautogui.click(x=120, y=40)

time.sleep(0.5)

pyautogui.click(x=120, y=180)

# ... 後續需要再處理 20+ 個步驟的座標與等待邏輯

# 總程式碼行數:約 300 行

# 維護難度:每次 Xcode 更新或解析度變更需全面測試OpenClaw 方案

# OpenClaw 任務定義(YAML 格式)

workflow: "TestFlight Auto Publish"

steps:

- action: "開啟 Finder 並導航至專案資料夾"

path: "/Users/vpsmac/MyApp"

- action: "雙擊 MyApp.xcodeproj 以開啟 Xcode"

- action: "等待 Xcode 完全載入專案"

timeout: 30s

- action: "點擊頂部選單列的 Product,選擇 Archive"

- action: "等待 Archive 完成,當看到 'Archive succeeded' 訊息時繼續"

- action: "在彈出的 Organizer 視窗中,點擊 Distribute App"

- action: "選擇 TestFlight & App Store 選項並點擊 Next"

- action: "保持預設設定並持續點擊 Next 直到開始上傳"

- action: "監控上傳進度,成功後點擊 Done"

- action: "關閉所有 Xcode 視窗"

# 總定義行數:約 30 行

# 維護難度:介面變更時無需修改(視覺自適應)效能對比結果

在連續 10 次測試中(VPSMAC M4 Max 64GB 節點,Xcode 15.3,專案大小約 150K 行程式碼):

- 傳統腳本:成功率 60%(4 次因座標偏移失敗,2 次因網路延遲未正確等待),平均執行時間 42 分鐘(含人工介入修復)

- OpenClaw:成功率 90%(1 次因 TestFlight 伺服器錯誤失敗),平均執行時間 38 分鐘(完全無人值守)

六、在 VPSMAC M4 遠端節點上部署 OpenClaw 的優勢

OpenClaw 的視覺推理依賴 GPU 加速與大記憶體頻寬,這正是 M4 芯片的強項。在 VPSMAC 的物理 M4 節點上:

- 統一記憶體架構(UMA):OpenClaw 處理 4K 螢幕截圖時,無需在 CPU 與 GPU 間複製記憶體,單次視覺推理延遲可降至 1.2-1.8 秒(相比傳統 x86 伺服器的 3-5 秒)

- 20 核 GPU 硬體加速:視覺模型(如本地部署的 LLaVA)可完全在 GPU 上執行,無需依賴外部 API,既降低成本也保障資料隱私

- 原生 macOS 環境:無虛擬化損耗,Accessibility API 與螢幕錄製權限可正常運作,確保 OpenClaw 能完整存取系統功能

- 24/7 雲端執行:節點位於數據中心,可全天候執行自動化任務,而無需佔用開發者在地的 Mac 資源

七、技術限制與適用場景

儘管 OpenClaw 在複雜 UI 自動化中展現出明顯優勢,但仍有其適用邊界:

- 高頻操作場景:若任務需要每秒執行數十次點擊(如遊戲自動化),傳統腳本的毫秒級延遲仍具優勢

- 完全確定性流程:若應用程式介面極度穩定且未來不會變更(如內部工具),傳統腳本的開發成本可能更低

- 無網路環境:若 OpenClaw 依賴雲端視覺模型(如 GPT-4V),則需穩定網路連線;但可透過本地部署模型(如 LLaVA)解決

然而對於介面經常變動、流程複雜、需跨多個應用協作、或需在遠端環境執行的自動化任務(如 CI/CD 流程、UI 測試、跨應用資料遷移),OpenClaw 的優勢是壓倒性的。

八、小結:自動化範式的代際躍遷

OpenClaw 與傳統腳本的差異,本質上是「硬編碼規則」與「智能理解」兩種範式的對抗。傳統腳本要求開發者將所有可能的介面狀態與操作邏輯預先編碼,這種方式在簡單場景下高效,但在複雜、動態、不可預測的環境中會迅速崩潰。而 OpenClaw 透過視覺理解與自然語言驅動,將「如何操作」的細節交由 AI 自主決策,開發者只需描述「想達成什麼目標」,這種抽象層次的提升使自動化任務的開發與維護成本降低了一個數量級。

在 VPSMAC 的 M4 遠端節點上,這種優勢被進一步放大:物理硬體的 GPU 加速、統一記憶體架構、原生 macOS 環境,以及 24/7 可用的雲端資源,使 OpenClaw 能在最佳狀態下執行,為開發者提供了一個真正「智能化」的遠端自動化平台。對於獨立開發者或小型團隊而言,這種技術組合已不僅是效率工具,更是將「一人開發團隊」的生產力推向接近中型團隊水準的關鍵基礎設施。