2026 OpenClaw 在 Mac 云上对接 Ollama 本地模型:Provider、超时与健康检查回退清单

谁、什么问题:已能跑通 OpenClaw 网关与云端 Key,但希望把部分会话切到 Ollama 本地模型以降低延迟与按 token 计费;一上生产就遇到「Thinking 很久无回复、模型偶发 500、不知道先查网关还是先查 ollama serve」。本文结论:用同机/分机对照表定边界,把模型名、HTTP base、超时与重试写进可审计配置,并预留云端 Provider 作为硬回退。结构:痛点编号清单、架构决策表、七步落地、三条可引用资源参数、CTA 前转化段与 FAQ/HowTo 结构化数据。具体键名与 UI 以你所用 OpenClaw 版本官方文档为准。

本文要点

1. 导语摘要:网关、Ollama 与云端 Key 的分工

OpenClaw Gateway 负责会话路由、工具调用与多通道;语言模型既可以走云端 API Key,也可以走兼容 OpenAI 语义的本地 HTTP 端点。Ollama 在 Mac 上常监听 127.0.0.1:11434,通过 /api/chat 或兼容层对外提供推理。把本地模型接进网关时,真正容易翻车的是三类错位:模型名字符串与 ollama list 不一致、base URL 在 Docker 与宿主机之间指错命名空间、以及超时设得过短导致通道侧只看到「Thinking」而工具链早已放弃。本文默认你在 Apple Silicon Mac 云或同等环境上已有 SSH,并已完成基础网关安装;目标是让「本地优先、云端兜底」成为可复现策略,而不是手工改一次算一次。

2. 痛点拆解:端口、模型名、超时与通道误报

进阶用户反馈的问题高度集中,可按下面四条自查:

- 绑定地址过窄:Ollama 仅监听 loopback,而 Gateway 跑在容器网络里,HTTP 客户端永远连不上;或反过来把 0.0.0.0 暴露到公网却未配套鉴权,引发安全评审一票否决。

- 模型名复制错误:标签带

:latest与不带、大小写或组织前缀不一致,表现为 404 或空响应,通道里却像「模型沉默」。 - 超时与并发:7×24 节点上同时跑多个会话,本地推理队列拉长;若网关 HTTP 客户端超时低于冷启动加载时间,会误报 Provider 不可用。

- 回退顺序不清:本地失败后若未配置第二 Provider,用户体验是直接断答;若回退到云端却未限额,账单会在故障窗口反向冲高。

3. 架构对照:Ollama 同机 vs 分机

评审架构时可直接使用下表对齐安全与运维责任。

| 维度 | Ollama 与 Gateway 同机 | Ollama 在分机/另一容器 |

|---|---|---|

| 网络路径 | 127.0.0.1 或宿主机桥接,延迟最低 | 需固定内网 IP/服务名,TLS 与防火墙策略单独设计 |

| 隔离 | 进程级;适合单租户 Mac 云 | 故障域分离;适合 GPU/内存独占节点 |

| 暴露面 | 禁止将 11434 直接暴露公网;配合 SSH 隧道或零信任 | 仅允许网关安全组访问推理端口 |

| 排障 | curl 本机自检即可 | 需分段抓包或 mTLS,定位链路更长 |

| 适用 | 个人与小团队 PoC、低到中等并发 | 平台化多租户或重模型分载 |

4. 落地步骤:从空配置到可回退的七步

- 安装并确认 Ollama:在目标机执行

ollama --version,用ollama pull拉取目标模型,ollama list记录精确名称。 - 本机探活:对

http://127.0.0.1:11434/api/tags或官方健康路径执行curl,确认进程监听与防火墙放行一致。 - 在 Gateway 侧登记本地 Provider:填写 base URL(容器内访问宿主机时常用主机网关 IP 或 host 网络模式)、模型名字符串、API 形态(OpenAI 兼容或原生)。

- 设置超时与重试:冷启动模型可能数十秒;为 HTTP 客户端设置分层超时(连接 / 首字节 / 总时长),避免与通道心跳冲突。

- 配置云端回退:为同一逻辑助手或路由规则指定次优 Provider(如 Anthropic/OpenAI Key),并限制故障切换窗口内的最大 token。

- 接入进程管理:用

launchd或等价方式保证 Ollama 与 Gateway 同序启动;记录日志路径与轮转策略。 - 验收对话:用固定提示词连跑三次,分别记录首 token 时延、完整耗时与失败率,再切到高并发压测观察队列。

示例:本机快速自检(请按环境替换模型名)。

5. 可引用信息:内存、并发与超时预算

下列数字用于容量沟通,需以具体模型卡与量化档位为准:

- 统一内存:常见 7B 级 Q4 量化在 Apple Silicon 上约需 5~6GB 级别权重驻留;同时开网关、通道插件与第二个模型时,32GB 以下机器更易触发交换分区抖动。

- 并发会话:每增加一条并行会话,峰值显存/内存近似线性叠加;生产上常用「单模型单队列 + 云端溢出」而非无限本地并行。

- 超时建议:首 token 预算可设在数十秒级以覆盖冷启动;稳定后 p95 若仍高于业务阈值,应优先减并发或换更小模型,而不是盲目缩短超时掩盖问题。

- 磁盘:多版本模型并存可迅速占用数十 GB;在 Mac 云上应配合磁盘水位告警与定期

ollama rm清理。 - 可观测性:为每次本地推理记录模型名、耗时与是否回退,才能在月底对齐「降本」与「可用性」两条曲线。

6. 排障:doctor、日志与通道 FAQ

建议固定顺序:openclaw doctor → Gateway 日志时间窗 → Ollama 进程与端口 → 再怀疑通道配置。若消息平台显示长时间 Thinking,先在网关侧确认 HTTP 是否已返回;若 HTTP 成功但通道无声,再查配对、mention 与速率限制。下表汇总常见现象。

| 现象 | 优先检查 | 次要检查 |

|---|---|---|

| 立即 404 / model not found | ollama list 与配置字符串 | 是否指向了错误的 base URL |

| 偶发超时 | 冷启动与并发队列 | 磁盘与交换是否触发 |

| 通道无回复 | 网关心跳与工具错误是否吞掉 | IM 侧 webhook/权限 |

| 回退后费用飙升 | 切换条件与 token 上限 | 是否在重试风暴中反复打云端 |

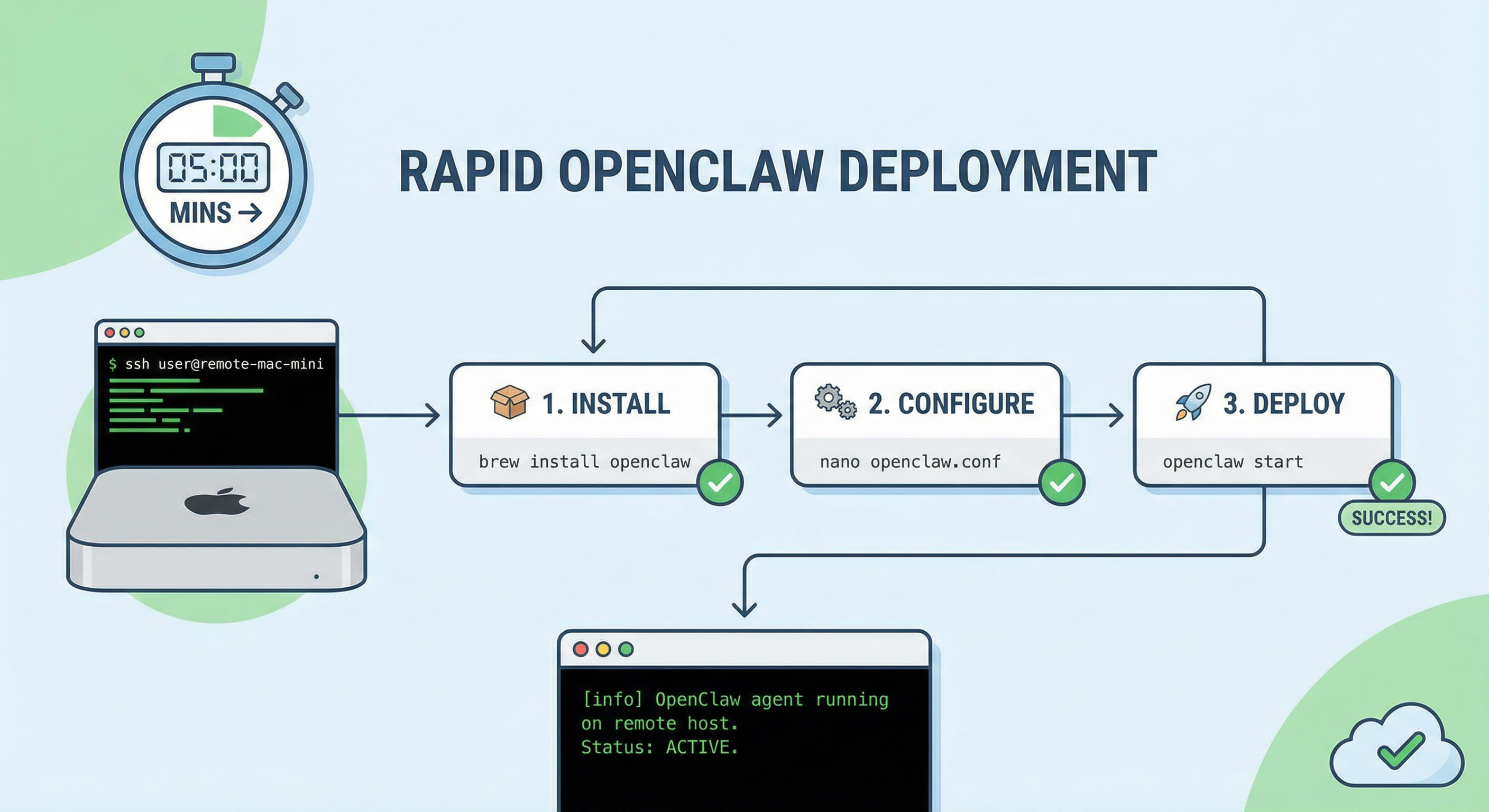

在 Windows 或通用 Linux VPS 上通过远程桌面或嵌套虚拟化硬跑 macOS 工具链,往往面临许可、性能与图形栈缺口,排障小时数很快超过租金。Docker 里叠一层 Ollama 看似省机器,却增加卷权限、网络命名空间和 DNS 变量,长期 7×24 运维并不划算。对需要 Apple Silicon 向量性能、稳定 launchd 与官方工具链共存的生产场景,把 OpenClaw Gateway 与 Ollama 落在可 SSH 的专用 Mac 云主机上,通常比继续堆叠异构环境更省心;算力与开通节奏可与站内「五分钟部署」类实操文章衔接,完成从试跑到常驻的闭环。