2026 OpenClaw Produktions-Observability: Befehlsleiter, JSONL, Gateway-Probes & tägliche Token-Checks (Mac Cloud 24/7)

Erstes Deploy und Port 18789 sind erledigt, dennoch bleibt Produktion undurchsichtig. Zielgruppe: Teams, die OpenClaw dauerhaft auf Mac Cloud oder Servern betreiben. Dieser Leitfaden beantwortet drei Kernpunkte: grüne UI ersetzt keinen gesunden RPC-Probe, fehlende ERROR-Zeilen beweisen keine Kanalzustellung, Token- und spawn-Nutzung kann leise steigen, bis Finance oder Tickets es zeigen. Inhaltlich: offizielle Troubleshooting-Befehlsleiter, praktische JSONL-Tail-Reihenfolge für 2026-Builds, 15-Minuten-Abnahme nach Upgrade (auth, bind, remote/local) und tägliche, ohne Prometheus ausführbare Schwellen. Ergänzend Silent-Failures und Heartbeat sowie sessions_spawn lesen, damit Observability nicht mit Einmal-Triage verwechselt wird.

Inhalt

1. Drei Schmerzpunkte: warum „keine Fehler“ nicht reicht

OpenClaw spannt sich von CLI-Konfiguration, Gateway-Prozess, WebSocket/RPC, Kanal-Plugins und Modellanbietern bis zu Kind-Sessions wie sessions_spawn. Viele Mac-Cloud- oder Linux-VPS-Setups stoppen bei „Prozess läuft, Dashboard lädt“ und vermissen geschichtete Gesundheitsnachweise. Typische Fehldiagnosen: Kanalprobleme als Modellqualität, Remote-URL-Drift als „OpenClaw kaputt“, halbe Docker-Bind-Mount-Rechte als Zufalls-Flakes. Nach Upgrades (OPENCLAW_*-Migration) folgt fast immer ein graues Fenster: sieht gut aus, ist aber halb konfiguriert.

- Probe vs. UI:

Runtime: runningist nichtRPC probe: ok. Untergateway.mode=remotekann die CLI die falsche Upstream-Instanz treffen, während ein lokaler Dienst müßig läuft—häufig Timeouts statt lauter ERRORs. - JSONL-Disziplin: Strukturierte Logs brauchen eine feste Lesereihenfolge; sonst versinkt man in INFO-Heartbeats und übersieht einzeilige

rate_limit- oderspawn_rejected-Ereignisse. Zuerst nach Level/Zeitfenster filtern, dann per Request-ID korrelieren. - Kosten und spawn-Stille: Tokens und Sub-Agent-Calls steigen, während die UX nur „etwas langsamer“ wirkt—das ist eine andere Achse als Sandbox-Rechte in der sessions_spawn-Anleitung; hier braucht es Baselines und einfache Schwellen.

Für Docker openclaw doctor im Container und auf dem Host ausführen; Abweichungen deuten auf Split-Brain-Konfiguration—siehe Docker-/doctor-Pfad.

2. Signal-Triage: Lärm vs. Muss-Fix

Die Tabelle neben dem On-Call-Blatt ausdrucken. P0 stoppt Rollouts, P1 trennt Kanal/spawn, P2 prüft Uhrzeit und Umgebung.

| Signal | Prio | Aktion | Vermeiden |

|---|---|---|---|

RPC probe: failed nach bind/auth-Änderung | P0 | Rollout einfrieren; gateway.mode, bind, token diffen | Sofort npm global neu installieren |

Provider-429-Serie | P0 | Parallelität senken; Long-Context togglen; Backoff | Blinde Retries |

| Kanal-Probe fällt aus, Gateway läuft | P1 | channels status --probe; Bot-Scopes/URL | Temperature drehen |

| Spawn akzeptiert, keine Kind-Artefakte (bekannte Muster) | P1 | Release Notes; Restart-Takt; Spawn-Artikel | „faules Modell“ beschuldigen |

| Einzelner fehlender INFO-Heartbeat | P2 | NTP/Zeitversatz prüfen | Nachts komplett neu schreiben |

Token-Rotationszeitstempel mit Probe-Failures abstimmen: Gateway-Token-Härtung.

3. Fünf+ Schritte: Leiter, Upgrade, Daily Checks

- Befehlsleiter (täglich oder vor Release):

openclaw status→openclaw gateway status(Runtime + RPC probe) →openclaw doctor→openclaw channels status --probe. Reihenfolge nicht ändern. Bei Remote-Gatewaysgateway.remote.urlmit CLI-Ziel und launchd-/systemd-Umgebung abgleichen. - JSONL-Tailing:

openclaw logs --follow(oder unterstützter RPC-Tail);warn/erroroder Keywords429,unauthorized,spawn. Bei stillen UX-Problemen Heartbeat-/Cron-Checkliste. - 15 Minuten nach Upgrade: Version laut Notes; Dienst-Restart wie dokumentiert; doctor sauber; Probenachricht im Kanal; minimaler spawn/cron mit Logzeile; Config-Diff besonders auth/bind/SecretRef. Jeder Schritt failt → zuerst Rollback (Upgrade-Überblick).

- Token-Schwellen: zwei menschliche Regeln, z. B. Tages-Tokens +80 % gegen 7-Tage-Median oder Spawn-Failrate >5 % in einer Stunde—im Standup sichtbar ohne Metrics-Stack.

- Mac Cloud 24/7: plist

StandardOutPath/StandardErrorPathan Gateway-Logverzeichnisse anbinden; gleiche Klasse wie launchd-Umgebungsdrift („SSH ok, Reboot schlecht“). - Optional Docker: Leiter-Schritt 1 auf Host und Container; gemountete Config als Single Source of Truth.

jq einheitlich grep -E 'warn|error|429|unauthorized|spawn' im Runbook fixieren, damit Übergaben konsistent bleiben.4. Auditfähige technische Notizen

Folgende Punkte schriftlich festhalten—das erhöht EEAT und beschleunigt Postmortems:

- RPC-Probe-Definition laut Herstellerdokumentation in einem Absatz.

- JSONL-Schema je Release-Version mit Release Notes versionieren.

- 429-Backoff mit nachvollziehbarer Retry-Obergrenze (Fehlerleitfaden).

- Spawn: Parallelitäts-Obergrenze und Fenster für Fehlerraten (z. B. gleitende Stunde).

- Gateway-Token: Rotationscadence vs. Least-Privilege-Tabelle.

- NTP: erlaubte Zeitskew-Grenze für WebSocket-/Auth-Fenster numerisch angeben.

5. Von stdout-only zur Mac-Cloud-Agentenbasis

OpenClaw auf improvisierten Linux- oder Windows-Desktops mit behelfsmäßiger Logsammlung funktioniert kurz, langfristig kämpft man mit Umgebungsdrift, unzuverlässigen Logpfaden unter unbeaufsichtigtem Start und schwierigeren Multi-Instance-Upgrades. Ein teures Dashboard ohne Leiter und JSONL-Feldvertrag lässt Vorfälle weiterhin undrillbar.

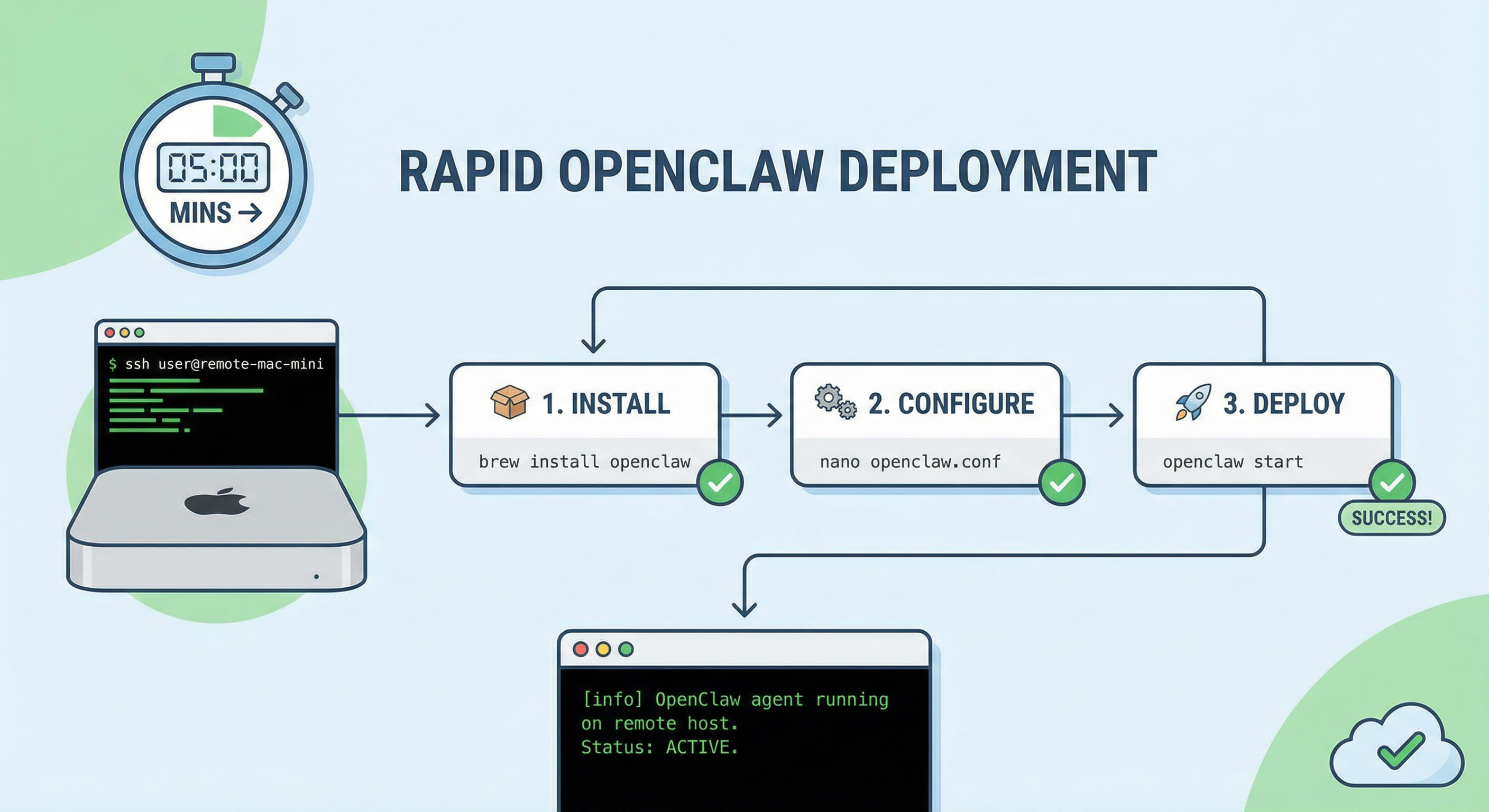

Den Produktions-Gateway auf elastischer Mac Cloud mit erstklassigem SSH und launchd zu legen erlaubt, Leiter, JSONL-Felder und plist-Logziele in einem Runbook zu kodifizieren und an 5-Minuten-M4-Deploy anzudocken. Für 24/7-Agenten, die auditierbar und gut recoverbar bleiben müssen, sind gemietete VPSMAC-M4-Mac-Knoten meist stabiler als ein Mix temporärer Workstations: Observability bedeutet weniger unbekannte Zustände, nicht mehr Bildschirme.

6. FAQ

Kein jq / JSONL—trotzdem starten?

Ja. Zuerst grep-Keywords und die vierstufige Leiter standardisieren; Struktur später nachziehen.

Remote vs. lokal?

Remote erfordert passende CLI-URL, Token und Dienstumgebung; Fehler in Erreichbarkeit, Auth und falscher Instanz splitten.

Bezug zur sessions_spawn-Artikel?

Dort Sandbox-Rechte; hier tägliche Gesundheit, Upgrades und Kostenschwellen—bei Incidents beides nutzen.